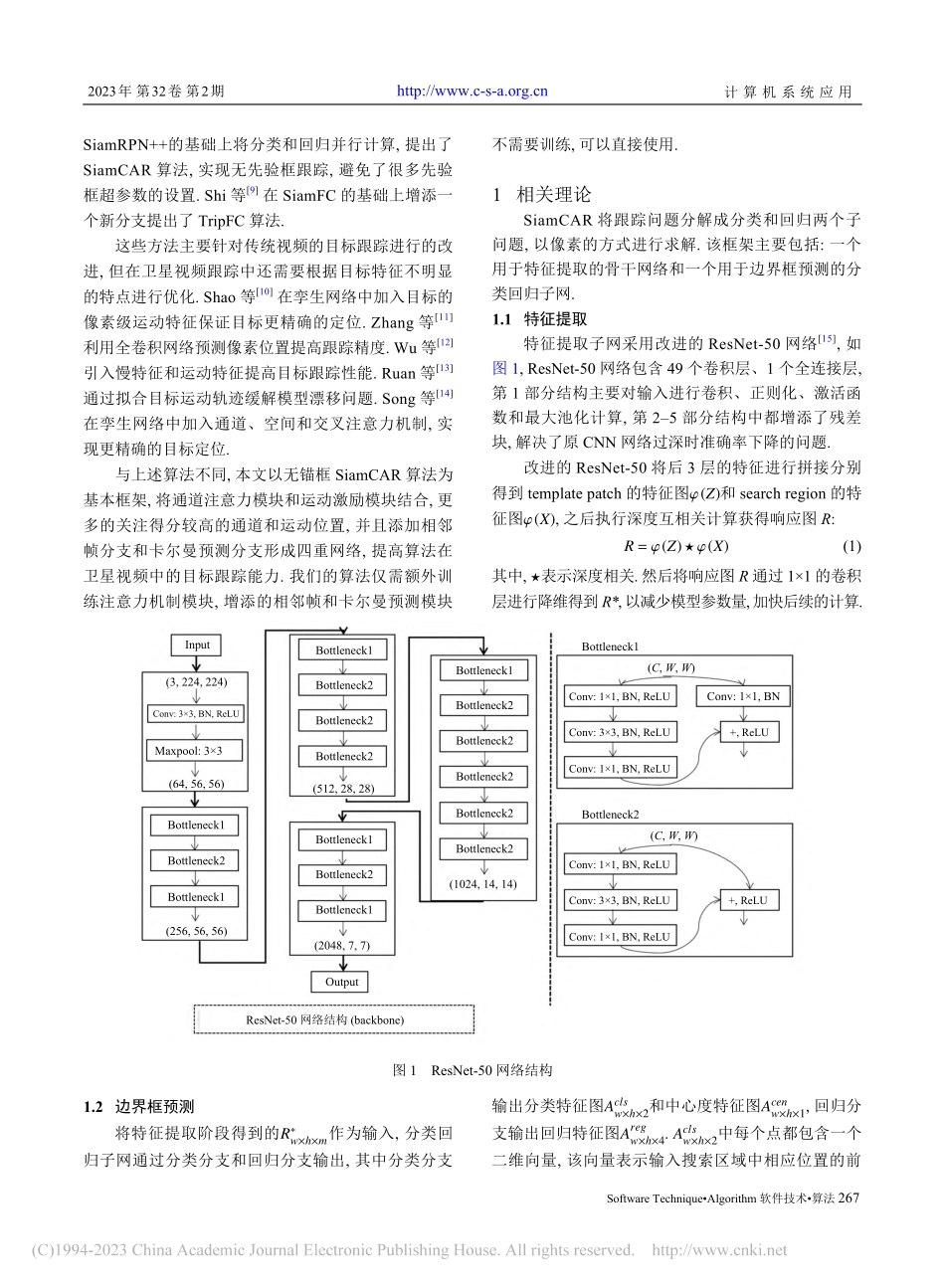

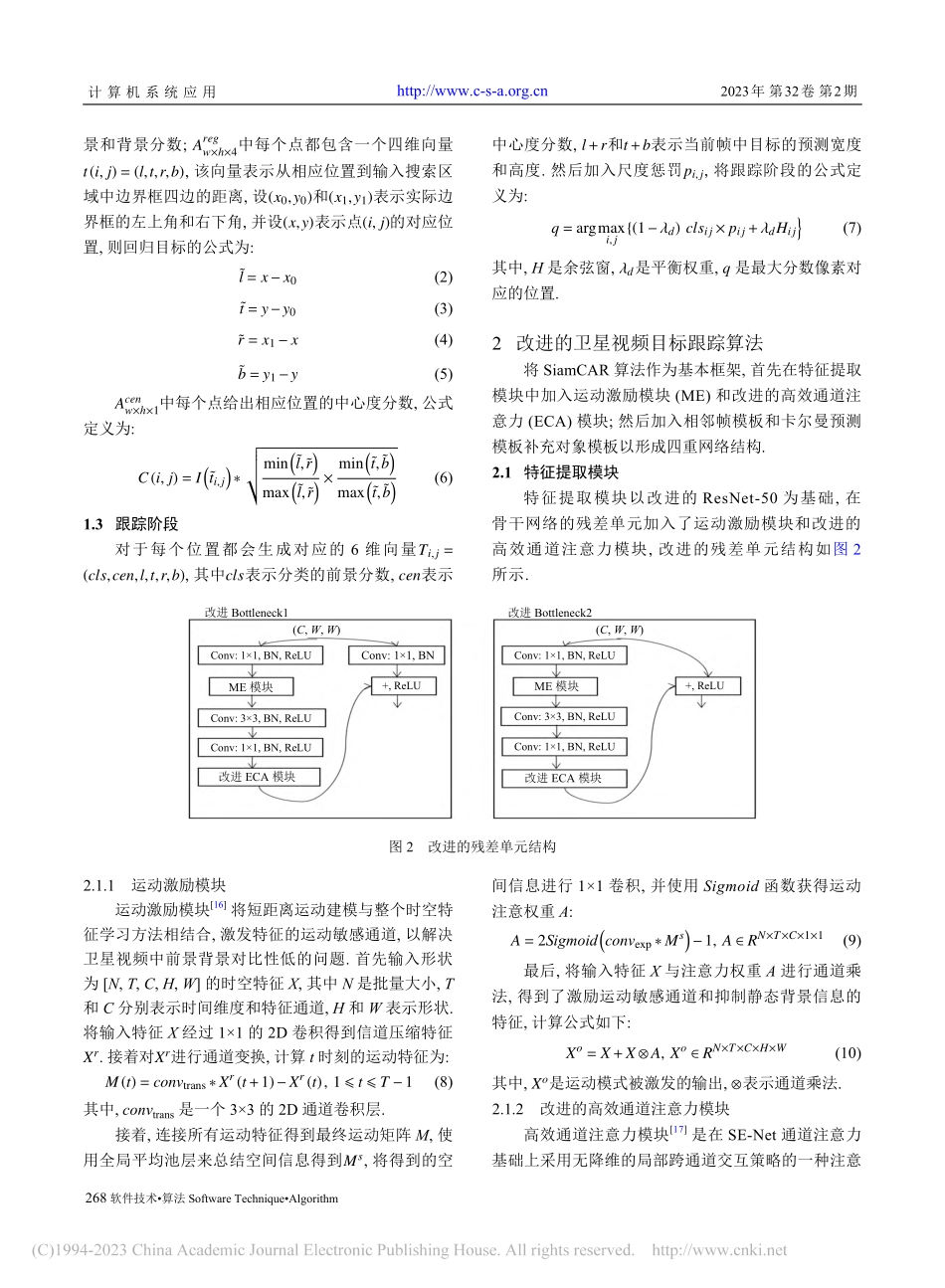

多信息融合的卫星视频单目标跟踪①王丽黎,张慧(西安理工大学自动化与信息工程学院,西安710048)通信作者:张慧,E-mail:2359498987@qq.com摘要:针对卫星视频中存在目标特征信息少、前景背景对比性低等问题,在SiamCAR的基础上提出了一种融合运动信息和注意力机制的目标跟踪方法;首先引入运动激励模块和通道注意力模块以增强目标特征提取信息;然后将相邻帧作为新模板添加到网络里形成三重网络补充模板信息;最后加入卡尔曼滤波算法进行目标轨迹预测,将预测模板添加到网络中形成四重网络增加目标的运动信息;选取SatSOT卫星视频数据集中的10组数据进行测试,实验结果表明与SiamCAR网络相比,改进算法的跟踪准确率和成功率分别提升了6%和6.2%.关键词:卫星视频;目标跟踪;SiamCAR;卡尔曼滤波;注意力机制;信息融合引用格式:王丽黎,张慧.多信息融合的卫星视频单目标跟踪.计算机系统应用,2023,32(2):266–273.http://www.c-s-a.org.cn/1003-3254/8995.htmlSingleTargetTrackingofSatelliteVideoBasedonMulti-informationFusionWANGLi-Li,ZHANGHui(SchoolofAutomationandInformationEngineering,Xi’anUniversityofTechnology,Xi’an710048,China)Abstract:Aimingattheproblemsoflesstargetfeatureinformationandlowcontrastbetweenforegroundandbackgroundinsatellitevideo,thisstudyproposesatargettrackingmethodintegratingmotioninformationandattentionmechanismbasedonSiamCAR.First,themotionexcitationandchannelattentionmodulesareintroducedtoenhancethetargetfeatureextractioninformation.Then,adjacentframesareregardedasnewtemplatesandaddedtothenetworktoformatriplenetworkandsupplementtemplateinformation.Finally,theKalmanfilteralgorithmisaddedtopredictthetarget’strajectory,andapredictiontemplateisintroducedtothenetworktoconstructaquadruplenetworkandincreasethemotioninformationofthetarget.Inaddition,10setsofdataintheSatSOTsatellitevideodatasetareselectedfortesting.TheexperimentalresultsshowthatcomparedwiththoseoftheSiamCARnetwork,thetrackingaccuracyandsuccessrateoftheimprovedalgorithmareincreasedby6%and6.2%,respectively.Keywords:satellitevideo;targettracking;SiamCAR;Kalmanfilter;attentionmechanism;informationfusion随着卫星技术的发展,卫星视频中的目标跟踪成为新的研究领域.而与普通视频相比...