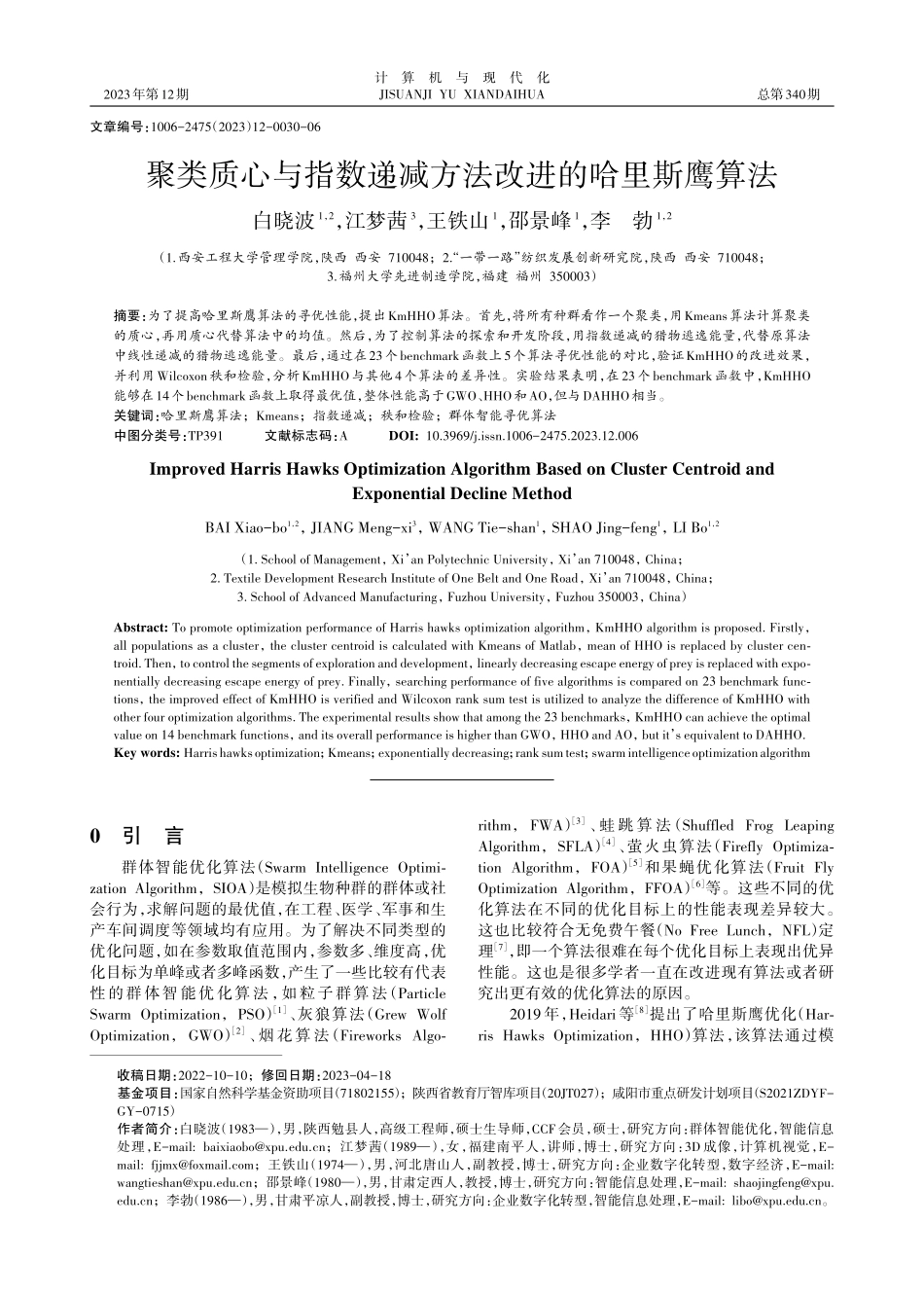

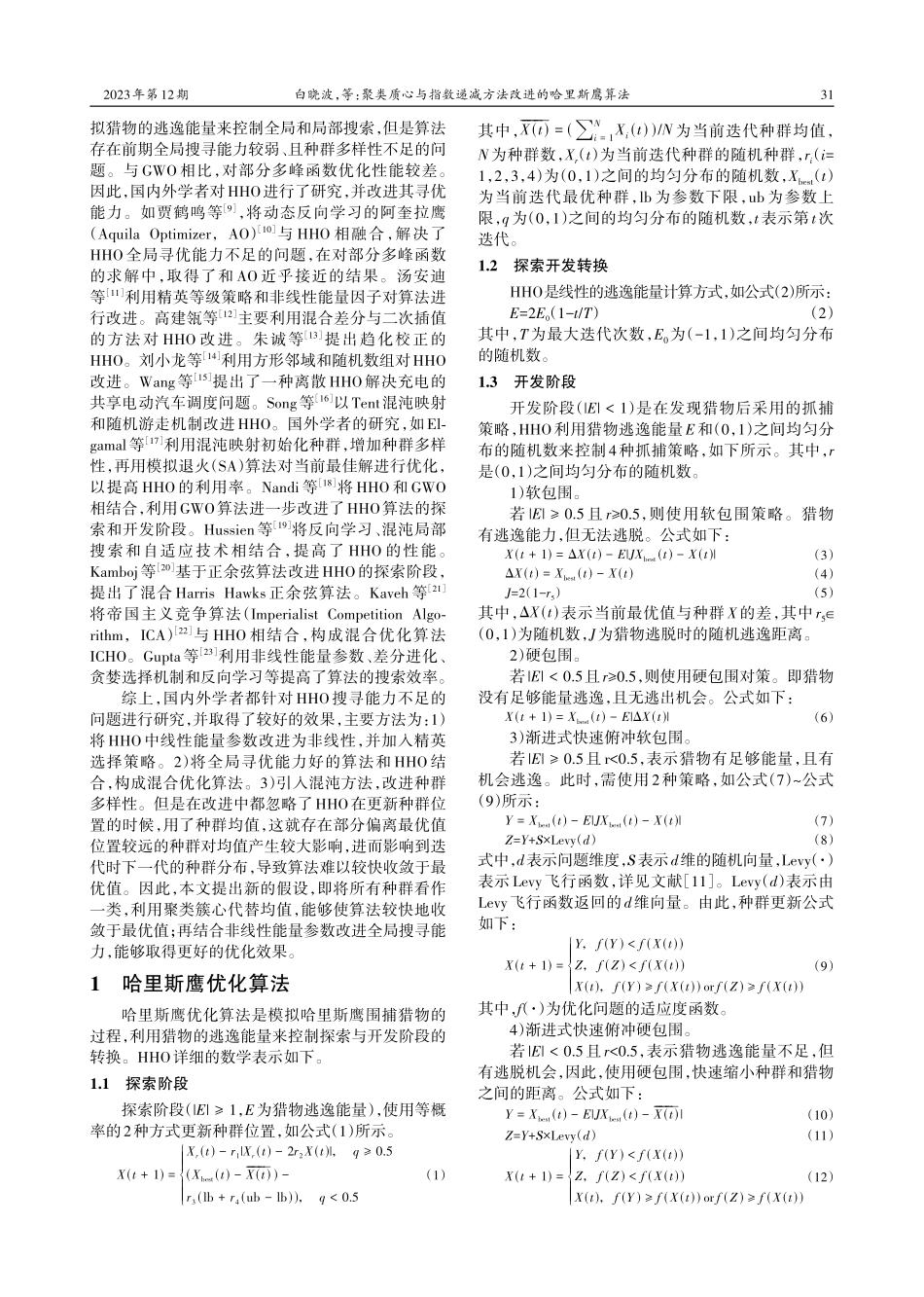

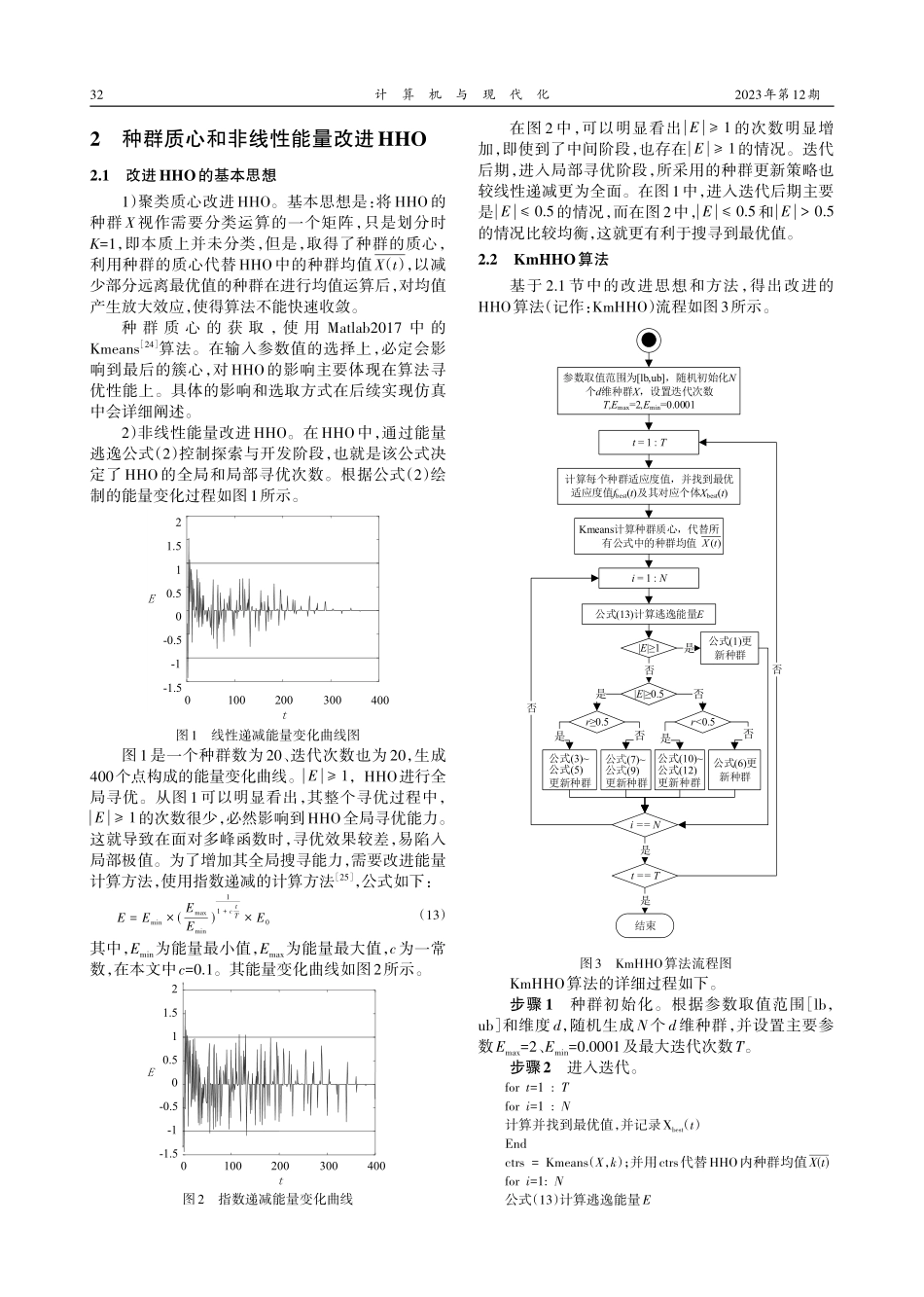

计算机与现代化JISUANJIYUXIANDAIHUA2023年第12期总第340期文章编号:1006-2475(2023)12-0030-06收稿日期:2022-10-10;修回日期:2023-04-18基金项目:国家自然科学基金资助项目(71802155);陕西省教育厅智库项目(20JT027);咸阳市重点研发计划项目(S2021ZDYF-GY-0715)作者简介:白晓波(1983—),男,陕西勉县人,高级工程师,硕士生导师,CCF会员,硕士,研究方向:群体智能优化,智能信息处理,E-mail:baixiaobo@xpu.edu.cn;江梦茜(1989—),女,福建南平人,讲师,博士,研究方向:3D成像,计算机视觉,E-mail:fjjmx@foxmail.com;王铁山(1974—),男,河北唐山人,副教授,博士,研究方向:企业数字化转型,数字经济,E-mail:wangtieshan@xpu.edu.cn;邵景峰(1980—),男,甘肃定西人,教授,博士,研究方向:智能信息处理,E-mail:shaojingfeng@xpu.edu.cn;李勃(1986—),男,甘肃平凉人,副教授,博士,研究方向:企业数字化转型,智能信息处理,E-mail:libo@xpu.edu.cn。0引言群体智能优化算法(SwarmIntelligenceOptimi⁃zationAlgorithm,SIOA)是模拟生物种群的群体或社会行为,求解问题的最优值,在工程、医学、军事和生产车间调度等领域均有应用。为了解决不同类型的优化问题,如在参数取值范围内,参数多、维度高,优化目标为单峰或者多峰函数,产生了一些比较有代表性的群体智能优化算法,如粒子群算法(ParticleSwarmOptimization,PSO)[1]、灰狼算法(GrewWolfOptimization,GWO)[2]、烟花算法(FireworksAlgo⁃rithm,FWA)[3]、蛙跳算法(ShuffledFrogLeapingAlgorithm,SFLA)[4]、萤火虫算法(FireflyOptimiza⁃tionAlgorithm,FOA)[5]和果蝇优化算法(FruitFlyOptimizationAlgorithm,FFOA)[6]等。这些不同的优化算法在不同的优化目标上的性能表现差异较大。这也比较符合无免费午餐(NoFreeLunch,NFL)定理[7],即一个算法很难在每个优化目标上表现出优异性能。这也是很多学者一直在改进现有算法或者研究出更有效的优化算法的原因。2019年,Heidari等[8]提出了哈里斯鹰优化(Har⁃risHawksOptimization,HHO)算法,该算法通过模聚类质心与指数递减方法改进的哈里斯鹰算法白晓波1,2,江梦茜3,王铁山1,邵景峰1,李勃1,2(1.西安工程大学管理学院,陕西西安710048;2.“一带一路”纺织发展创新研究院,陕西西安710048;3.福州大学先进制造学院,福建福州350003)摘要:为了提高...