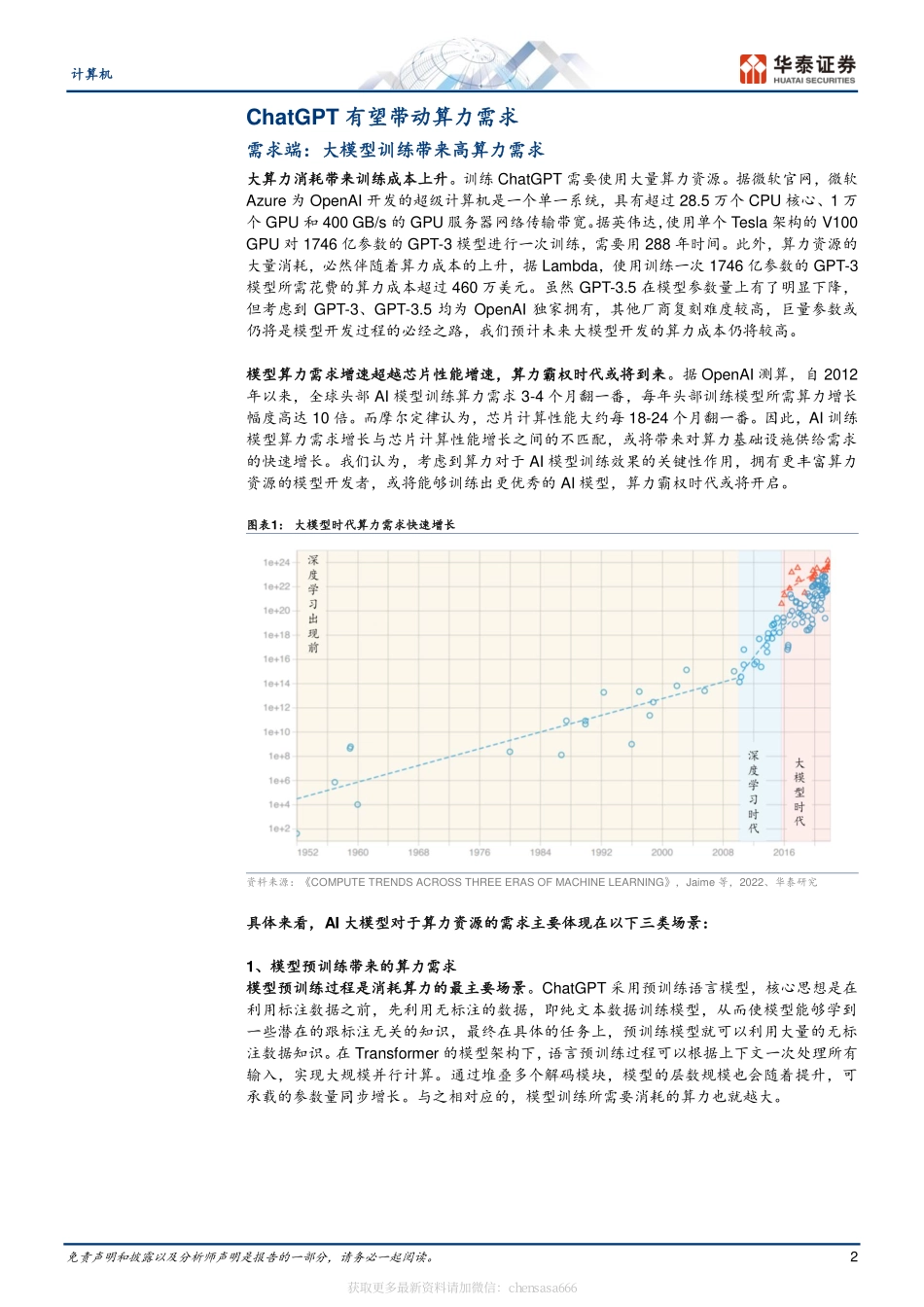

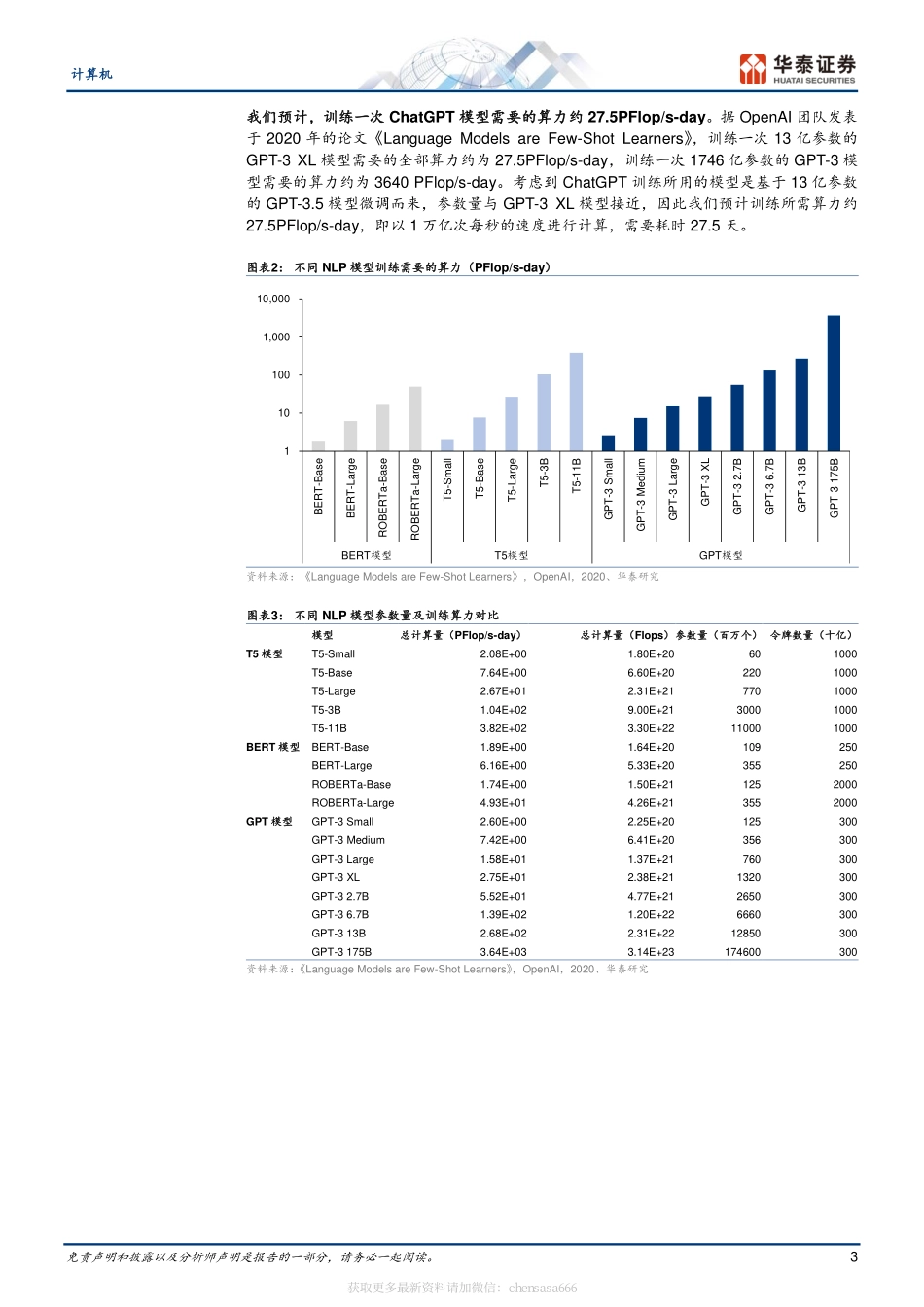

免责声明和披露以及分析师声明是报告的一部分,请务必一起阅读。1证券研究报告计算机从ChatGPT看算力产业机遇华泰研究计算机增持(维持)研究员谢春生SACNo.S0570519080006SFCNo.BQZ938xiechunsheng@htsc.com+(86)2129872036联系人林海亮SACNo.S0570122060076linhailiang@htsc.com+(86)2128972228行业走势图资料来源:Wind,华泰研究2023年2月13日│中国内地专题研究大模型训练热潮下,算力基础设施有望迎来产业机遇ChatGPT发布之后,引发了全球范围的关注和讨论,国内各大厂商相继宣布GPT模型开发计划。我们认为,以GPT模型为代表的AI大模型训练,需要消耗大量算力资源,随着国产大模型开发陆续进入预训练阶段,算力需求持续释放或将带动算力基础设施产业迎来增长新周期。产业链相关公司包括:1、算力芯片厂商:景嘉微、寒武纪、海光信息、龙芯中科、中国长城等;2、服务器厂商:浪潮信息、中科曙光等;3、IDC服务商:宝信软件等。ChatGPT:大模型训练带来高算力需求训练ChatGPT需要使用大量算力资源。据微软官网,微软Azure为OpenAI开发的超级计算机是一个单一系统,具有超过28.5万个CPU核心、1万个GPU和400GB/s的GPU服务器网络传输带宽。据英伟达,使用单个Tesla架构的V100GPU对1746亿参数的GPT-3模型进行一次训练,需要用288年时间。此外,算力资源的大量消耗,必然伴随着算力成本的上升,据Lambda,使用训练一次1746亿参数的GPT-3模型所需花费的算力成本超过460万美元。我们认为,未来拥有更丰富算力资源的模型开发者,或将能够训练出更优秀的AI模型,算力霸权时代或将开启。需求场景:预训练+日常运营+Finetune具体来看,AI大模型对于算力资源的需求主要体现在以下三类场景:1)模型预训练:ChatGPT采用预训练语言模型,核心思想是在利用标注数据之前,先利用无标注的数据训练模型。据我们测算,训练一次ChatGPT模型(13亿参数)需要的算力约27.5PFlop/s-day;2)日常运营:用户交互带来的数据处理需求同样也是一笔不小的算力开支,我们测算得ChatGPT单月运营需要算力约4874.4PFlop/s-day,对应成本约616万美元;3)Finetune:ChatGPT模型需要不断进行Finetune模型调优,对模型进行大规模或小规模的迭代训练,产生相应算力需求。算力芯片+服务器+数据中心,核心环节有望率先受益我们认为,随着国内厂商相继布局ChatGPT类似模型,算力需求或将持续释放,供给端核心环节或将率先受益:1)算力芯片:GPU采用了数量众多的计算单元和超长的流水线,...