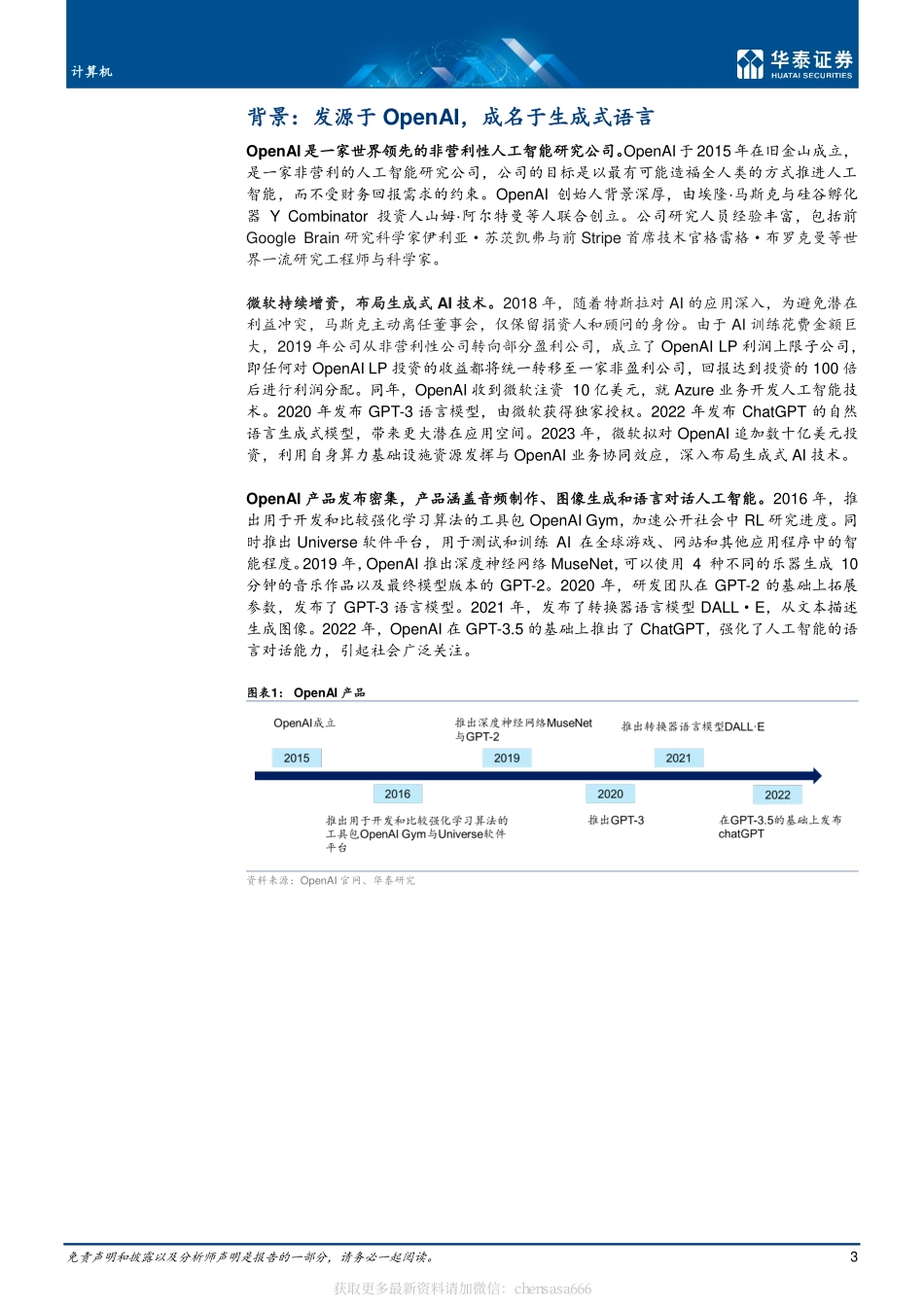

免责声明和披露以及分析师声明是报告的一部分,请务必一起阅读。1证券研究报告计算机ChatGPT:深度拆解华泰研究计算机增持(维持)研究员谢春生SACNo.S0570519080006SFCNo.BQZ938xiechunsheng@htsc.com+(86)2129872036联系人彭钢SACNo.S0570121070173penggang@htsc.com+(86)2128972228联系人林海亮SACNo.S0570122060076linhailiang@htsc.com+(86)2128972228行业走势图资料来源:Wind,华泰研究2023年2月09日│中国内地专题研究ChatGPT引发范式革命,AI产业发展前景可期近期由OpenAI团队发布的聊天机器人软件ChatGPT,凭借类人的语言理解和表达能力,引发AI产业范式革命。通过拆解ChatGPT,我们发现:1)单一大模型或为未来AI训练主流方向;2)大模型训练可以积累底层语言能力,但需要大算力支持;3)预训练语言模型和Transformer架构是模型底层能力的根源;4)ChatGPT商业化应用前景广阔。基于此,我们认为国产厂商或将训练出自己的GPT模型,AI产业有望迎来景气周期。目前国内在模型层面具备产业基础的相关企业包括:百度、商汤、云从科技等;在应用层持续推出新应用的相关企业包括:科大讯飞、金山办公、同花顺、汉王科技等;在底层基础设施和工具有布局的相关企业包括:寒武纪、景嘉微等。背景:发源于OpenAI,成名于生成式语言OpenAI于2015年在旧金山成立,主要从事人工智能研究。2019年OpenAI收到微软注资10亿美元,就Azure业务开发人工智能技术。2020年发布GPT-3语言模型,由微软获得独家授权。2022年,OpenAI在GPT-3.5的基础上推出了ChatGPT,强化了人工智能的语言对话能力,引起社会广泛关注。2023年,微软拟对OpenAI追加数十亿美元投资,利用自身算力基础设施资源发挥与OpenAI业务协同效应,深入布局生成式AI技术。原理:AI大模型里程碑式的胜利ChatGPT采用监督学习+奖励模型进行语言模型训练,主要包括三个步骤:1)第一阶段:训练监督策略模型。在ChatGPT模型的训练过程中,需要标记者的参与监督过程;2)第二阶段:训练奖励模型。借助标记者的人工标注,训练出合意的奖励模型,为监督策略建立评价标准;3)第三阶段:采用近端策略优化进行强化学习。通过监督学习策略生成PPO模型,将最优结果用于优化和迭代原有的PPO模型参数。我们认为,ChatGPT的训练过程采用单一模型+小样本学习+人类微调监督方式进行,取得了良好效果,验证了AI大模型应用前景,大模型路线有望成为未来主流。模型:三个维度拆解GPT模型特征我们认为,ChatGPT的成功离不...