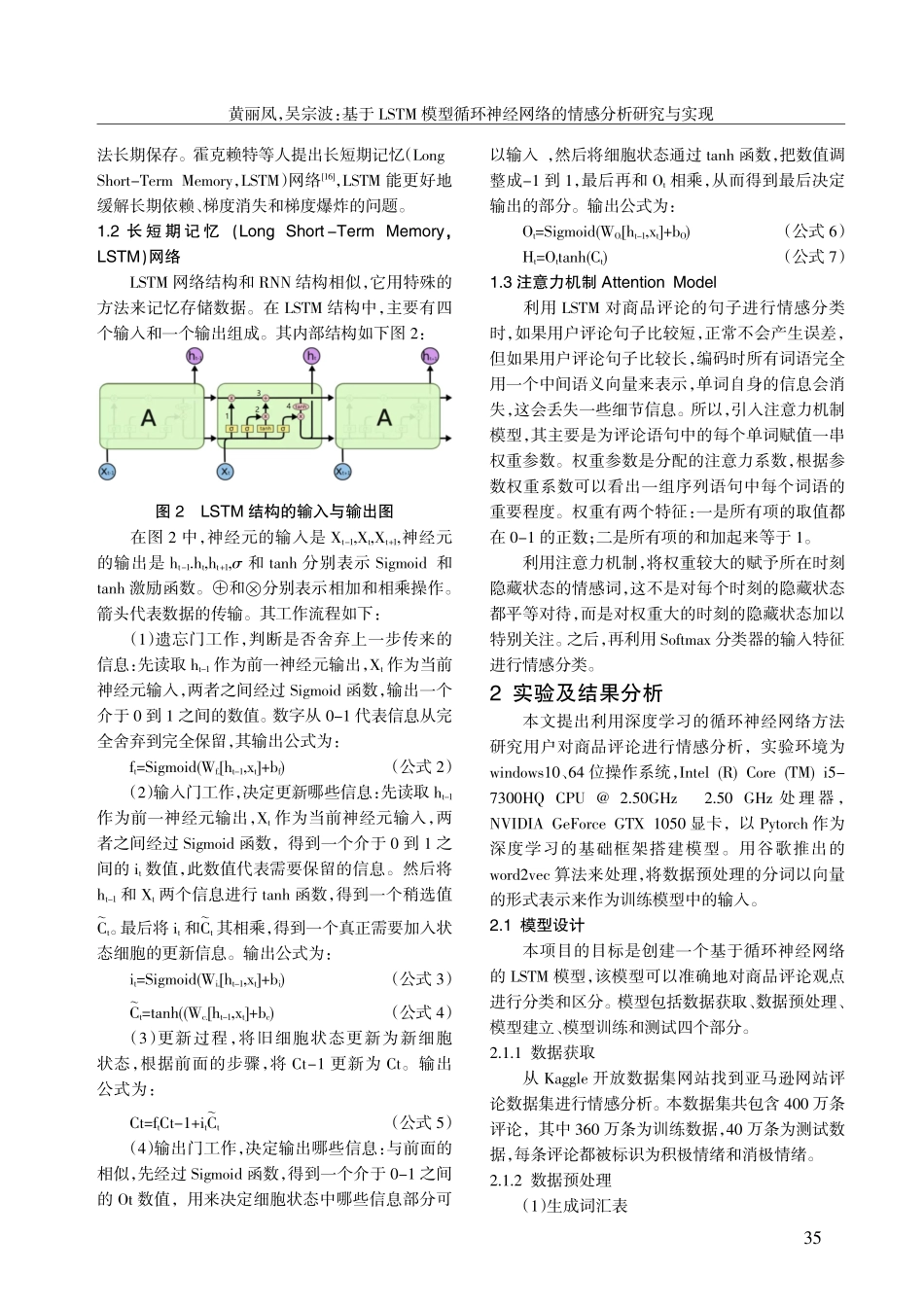

基金项目院福建省教育厅中青年教师教育科研项目(科技类):基于循环神经网络的情感分析(JAT210551)。作者简介院黄丽凤(1984-),女,福建泉州人,讲师,研究方向:软件工程、web开发、机器学习;吴宗波(1978-),男,安徽蚌埠人,讲师,研究方向:软件开发、人工智能、机器学习。收稿日期院2023-01-28基于LSTM模型循环神经网络的情感分析研究与实现黄丽凤,吴宗波泉州信息工程学院,福建泉州362000摘要:利用循环神经网络搭建基于LSTM模型,对网上商品评论信息进行情感分析。首先,利用word2Vec的词向量训练方法,解决传统文本中向量矩阵所占存储空间大,导致运行时间长的问题;其次,提出了标准长度零矩阵的填充算法,利用LSTM完成评论信息的自动“遗忘”和“记忆”,可提高模型的运行时间和准确率;最后,为提高模型的泛化能力,减少参数,提高拟合能力,对embedding层和LSTML单元进行随机失活。实验表明,可显著提高对商品评论的分类准确率,有效预测商品销售趋势。关键词:循环神经网络;LSTM模型;情感分析中图分类号:TP183文献标识码:A文章编号:2095-7734(2023)03-0034-03在互联网快速发展的推动下,越来越多的人喜欢足不出户进行网上购物。网上商品的性能、价格、实用性等评价信息已经成为了用户对商品好坏的情感描述。然而,这些情感信息,用户评价主观性较强,数据量大,文本信息不规范等现象,仅仅依靠人工去分析用户的情感是不精确的。为此,可以利用计算机自动化的文本挖掘技术来实现。它可以在最短的时间内,通过计算机,快速获取、整理、分析、归纳网络中大量带有个人情感,如积极,消极、中性等有价值的主观评价信息[1],通过这些信息去判断用户的感情倾向。目前,国内外对情感分析模型的研究主要划分成三个方法,基于词典的规则方法、机器学习方法和深度学习方法[2]。本文则将自注意力机制引入LSTM模型,构建基于深度学习方法的情感分类。1LSTM+AttentionModel情感分类模型全连接神经网络(FCNN)在同一层各个节点之间是没有连接的,无法使用序列之前时刻的信息,也就是没有办法处理前一个输入和后一个输入之间的关系。但在现实生活中,信息之间往往有很复杂的关联性和依赖性,因此循环神经网络(RecurrentNeuralNetwork,RNN)应运而生[14]。1.1循环神经网络(RNN)RNN主要的应用场景是处理时间序列问题数据,也就是神经元中某一时刻的输出可以作为下一时刻的输入。RNN的结构如图1所示。图1RNN结构图从图1可知,右边是每一个...