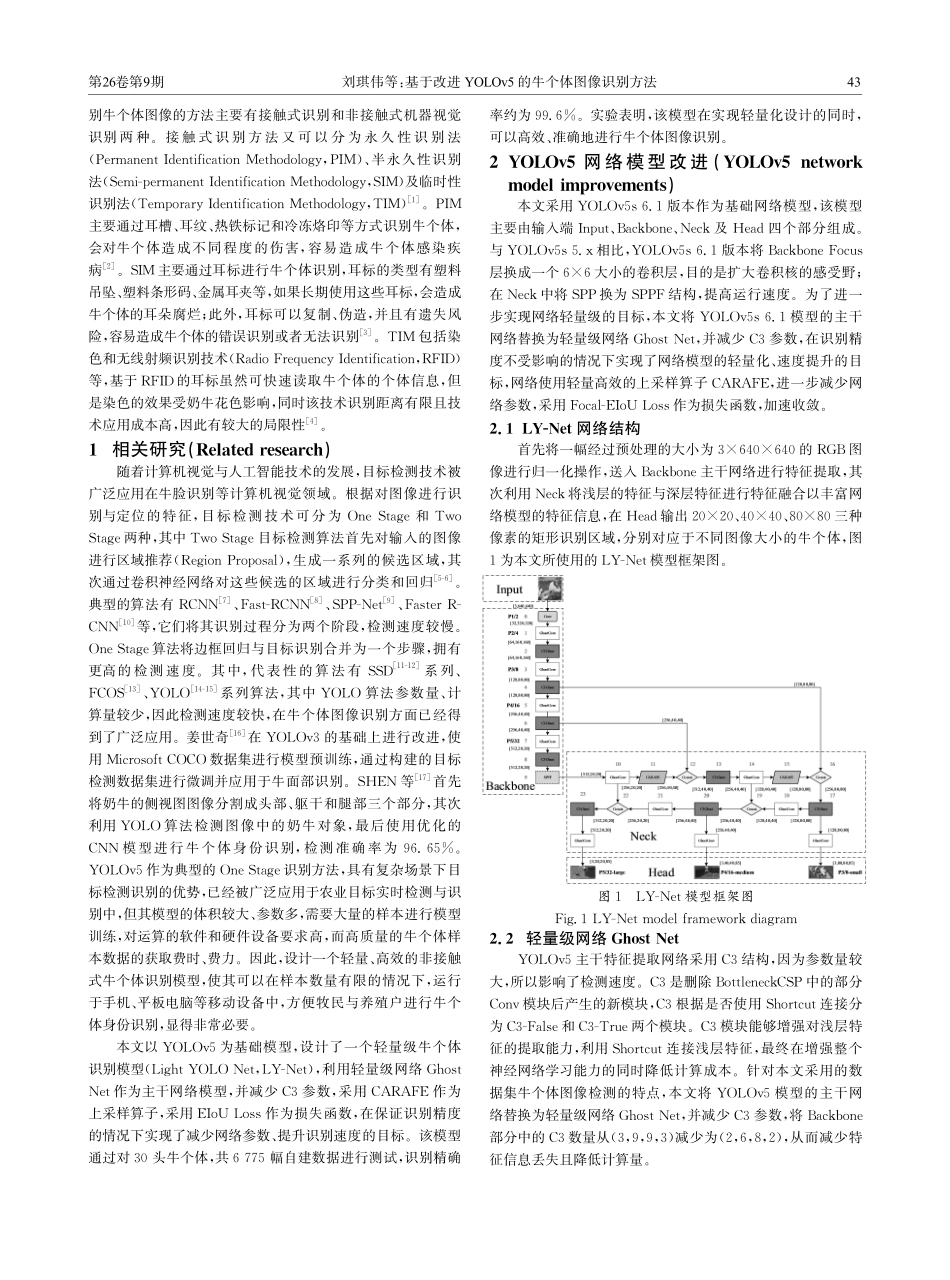

第26卷第9期2023年9月软件工程SOFTWAREENGINEERINGVol.26No.9Sep.2023文章编号:2096-1472(2023)09-0042-06DOI:10.19644/j.cnki.issn2096-1472.2023.009.008收稿日期:2023-02-15基金项目:甘肃农业大学盛彤笙创新基金项目(GSAU-STS-2021-16);甘肃农业大学青年导师基金项目(GAU-QDFC-2021-18);甘肃省自然科学基金项目(20JR5RA023)基于改进YOLOv5的牛个体图像识别方法刘琪伟1,郭小燕1,李纯斌2,杨道涵2(1.甘肃农业大学信息科学技术学院,甘肃兰州730070;2.甘肃农业大学资源与环境学院,甘肃兰州730070)lqw18394511172@163.com;guoxy@gsau.edu.cn;licb@gsau.edu.cn;529785408@qq.com摘要:针对现有非接触式牛个体图像识别模型体积大、参数多、资源占用较大等问题,提出了一种基于改进YOLOv5模型的轻量级牛个体图像识别模型(LightYOLONet,LY-Net)。将YOLOv5模型的主干网络替换为轻量级网络GhostNet,并采用CARAFE(轻量级通用上采样算子),减少网络参数,实现网络轻量化;采用Focal-EIoULoss作为损失函数,加速收敛并提高了速度。采用甘肃省张掖市某养殖场的30头牛,共6775幅牛个体图像作为样本数据,进行模型的训练、验证、测试。实验结果表明:LY-Net模型对牛个体的识别精确率约为99.6%,召回率约为99.5%。该模型能够在对牛个体图像高效且准确识别的同时,实现模型的小型化、轻量化。关键词:YOLOv5;牛个体;图像识别;轻量级中图分类号:TP391文献标志码:AAnImprovedYOLOv5-basedMethodforImageRecognitionofCattleIndividualLIUQiwei1,GUOXiaoyan1,LIChunbin2,YANGDaohan2(1.SchoolofInformationScienceandTechnology,GansuAgriculturalUniversity,Lanzhou730070,China;2.CollegeofResourcesandEnvironment,GansuAgriculturalUniversity,Lanzhou730070,China)lqw18394511172@163.com;guoxy@gsau.edu.cn;licb@gsau.edu.cn;529785408@qq.comAbstract:Aimingatthecurrentresearchproblemsoftheexistingnon-contactcattleindividualimagerecognitionmodels,suchaslargevolume,multipleparametersandlargeresourceoccupation,thispaperproposesalightweightcattleindividualimagerecognitionmodel(LightYOLONet,LY-Net)basedonimprovedYOLOv5model.ThebackbonenetworkoftheYOLOv5modelisreplacedbythelightweightnetworkGhostNet,andCARAFE(alightweightuniversalup-samplingoperator)isusedtoreducenetworkparametersandrealizenetworklightweight.Focal-EIoULossisusedasthel...