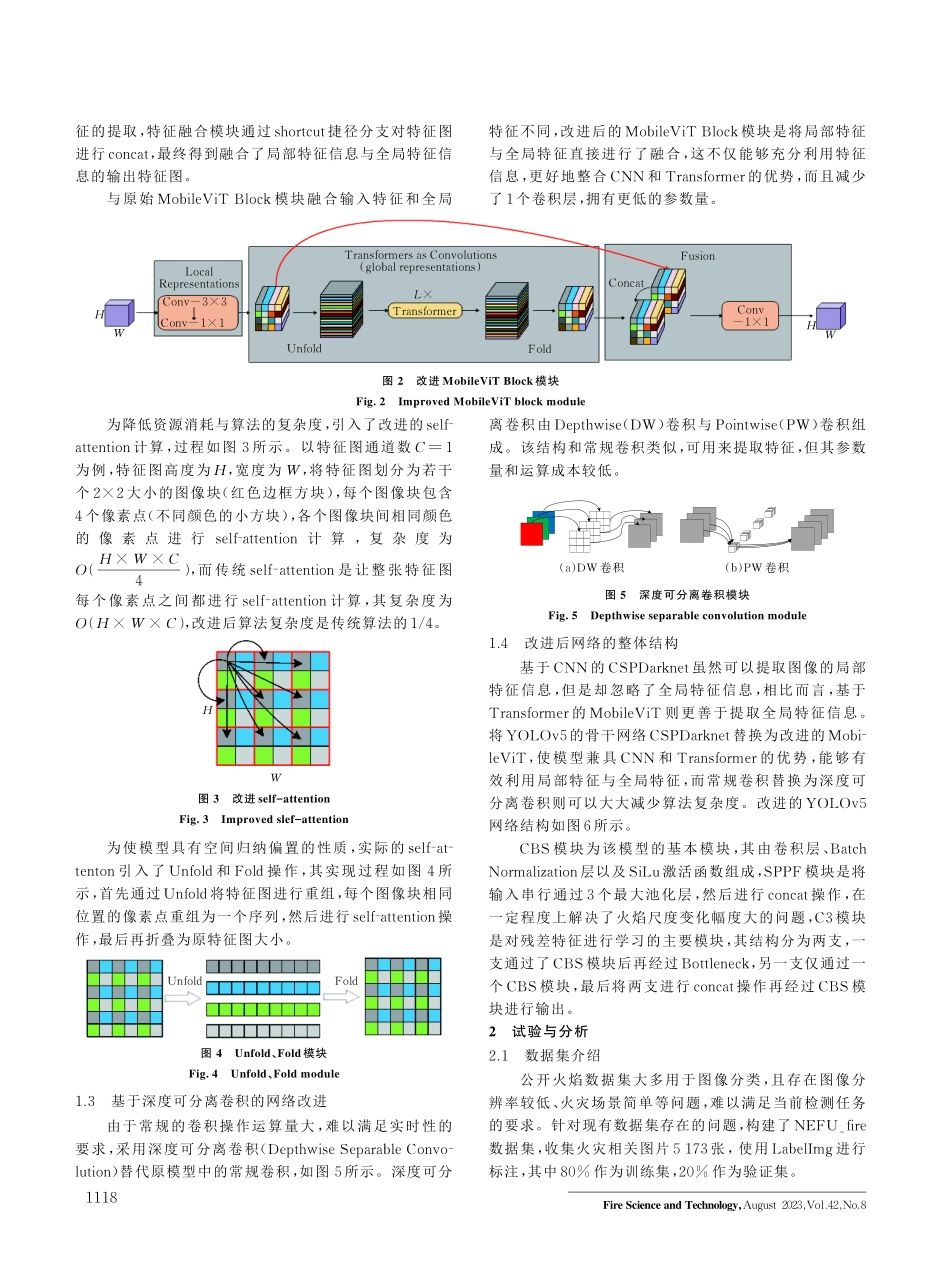

消防科学与技术2023年8月第42卷第8期消防设备研究基于改进YOLOv5的林火检测技术研究王乃宇1,王琢1,2,张子超1,吴金霆1(1.东北林业大学机电工程学院,黑龙江哈尔滨150040;2.东北林业大学林业人工智能研究院,黑龙江哈尔滨150040)摘要:为提高林火检测的准确率和检测速度,增强林火检测模型的实用性,提出了一种改进YOLOv5的林火检测算法。该算法将改进后的MobileViT作为YOLOv5的骨干网络,使网络能够更有效地提取林火特征信息,同时为进一步降低模型复杂度,采用深度可分离卷积替代模型中的普通卷积,在训练阶段引入了Mosaic数据增强的方法,以提高模型的泛化性。结果表明:改进后模型的林火检测精确率提高了2.25%,mAP提高了4.48%,检测速度提高了4帧/s,检测准确率和检测速度均取得了良好的效果。改进后模型能够很好地检测林火,提高了林火检测模型的实用性。关键词:林火检测;YOLOv5;MobileViT;深度可分离卷积中图分类号:X932;S126文献标志码:A文章编号:1009-0029(2023)08-1117-04森林资源与人类社会息息相关,一旦发生火灾,生态环境会遭到破坏,严重影响人类的生活环境和经济,甚至威胁人们的生命安全和健康[1-2]。火焰检测对于林火的发现和扑灭有重要意义,利用神经网络结合图像处理技术检测火焰成为各国学者的研究热点。在目前的研究中,叶铭亮等[3]将KNN自注意力引入到SwinTransformer模型中,提高了火焰检测的准确率。张苗等[4]基于YOLOv3网络架构实现了火灾的实时检测。ZHAOS等[5]改进了YOLOv4和视觉背景提取器(ViBe)算法,降低了火灾检测的误检率。蒋文萍等[6]基于多重迁移学习得到的YOLOv5在检测火焰上取得了较为理想的效果。王国睿[7]改进了CSPDarknet53骨干网络,进行多尺度特征图融合,提高了YOLOv4的精度。研究表明,基于YOLO和Transformer的火焰检测能够较为快速地提取火焰的特征,但YOLO和Transformer在实用性、可靠性方面仍处于初级阶段。笔者提出了一种基于YOLOv5的网络模型,融合了Transformer算法的优势,在实时性与准确率中取得了良好的效果。1算法介绍1.1YOLOv5算法YOLOv5网络模型由4部分构成:输入层Input,骨干网络Backbone,颈部Neck,预测部分Prediction。YO⁃LOv5采用CSPDarknet作为骨干网络,通过堆叠CSP模块进行特征提取,颈部是模型的中间连接模块,将提取的特征图进行特征加强与特征融合后,传递给预测部分进行预测与分类,得到目标的预测信息。YOLOv5包含了5种模型:YOLOv5n、YOLOv5s、...