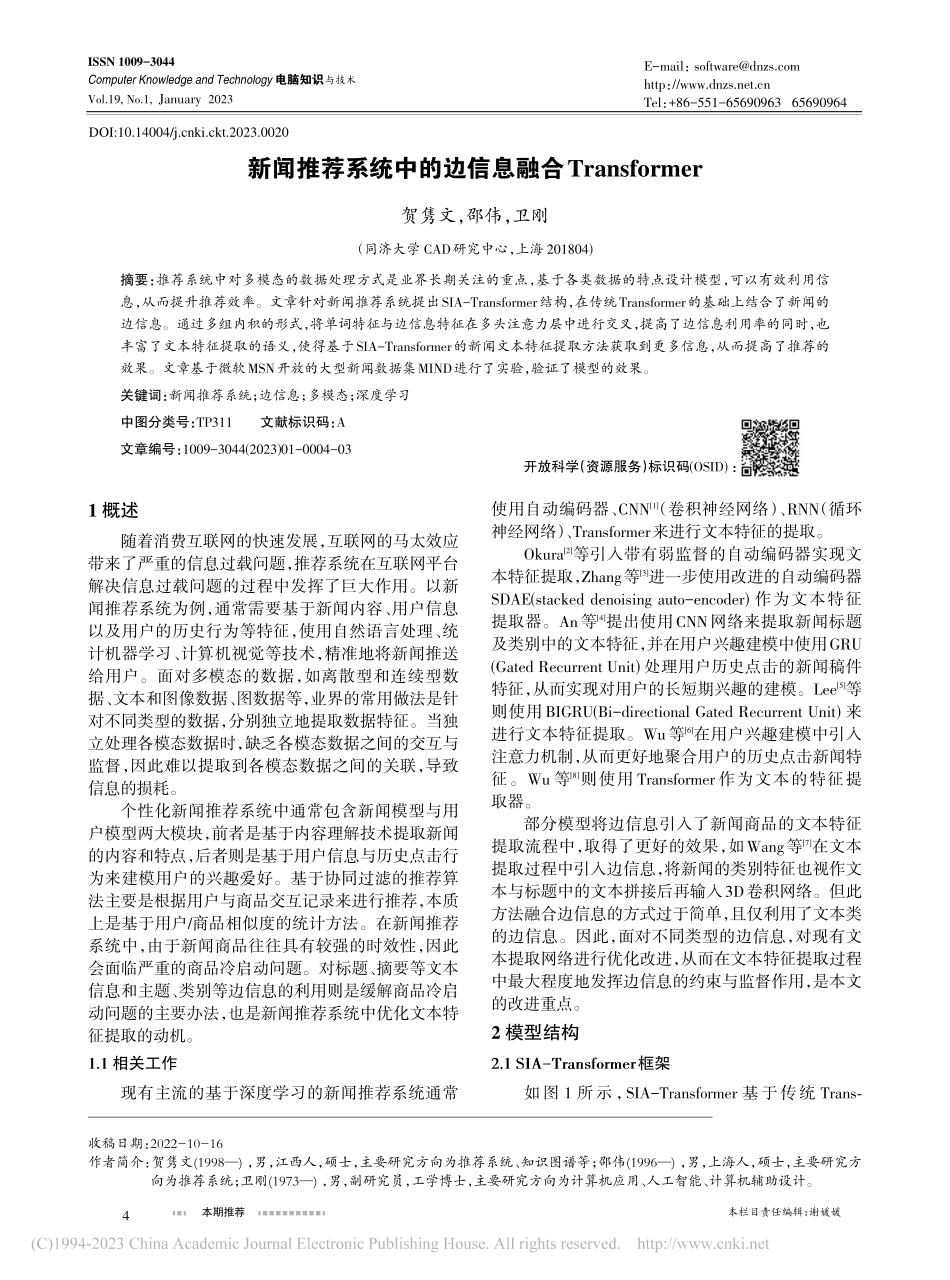

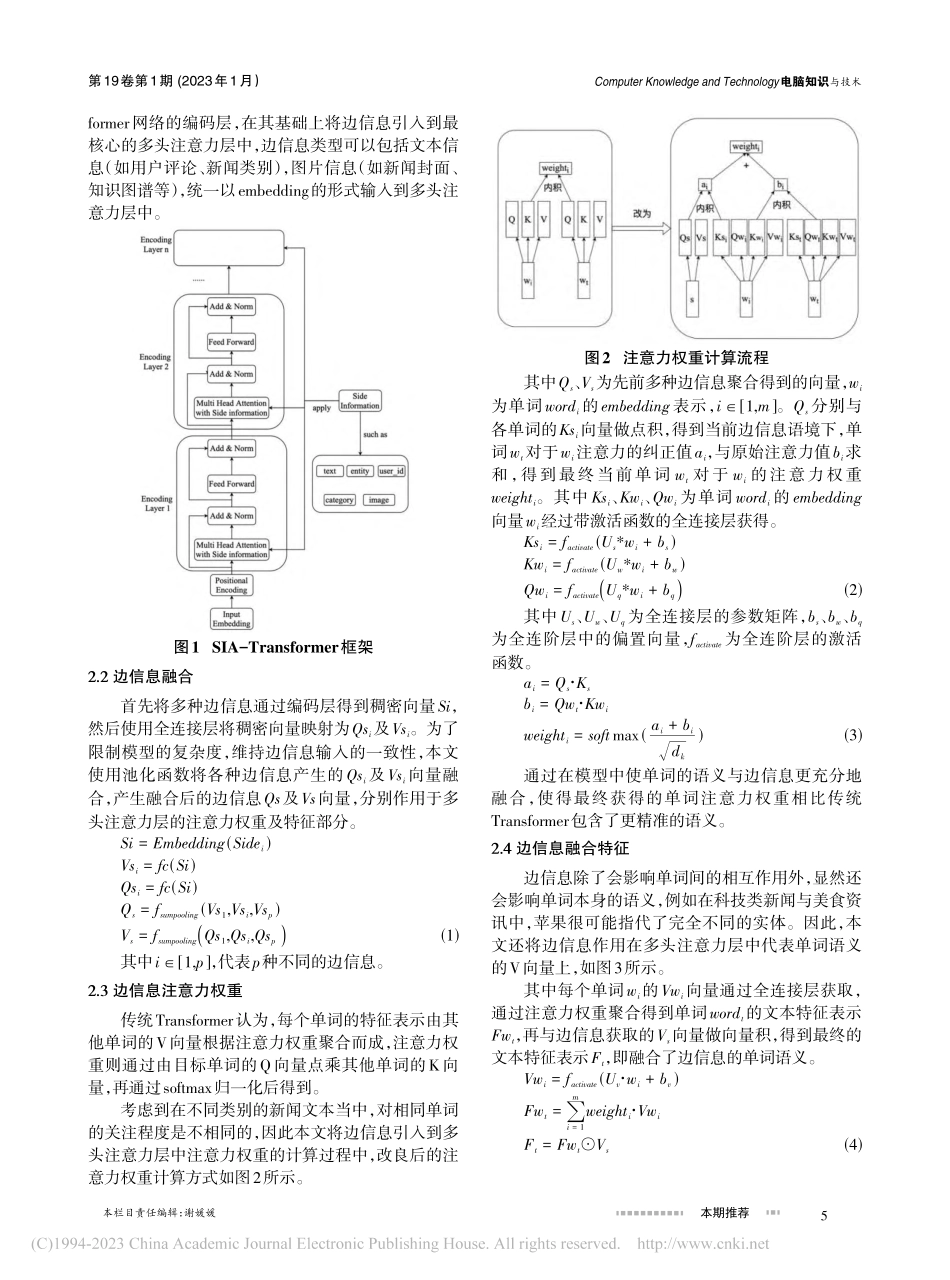

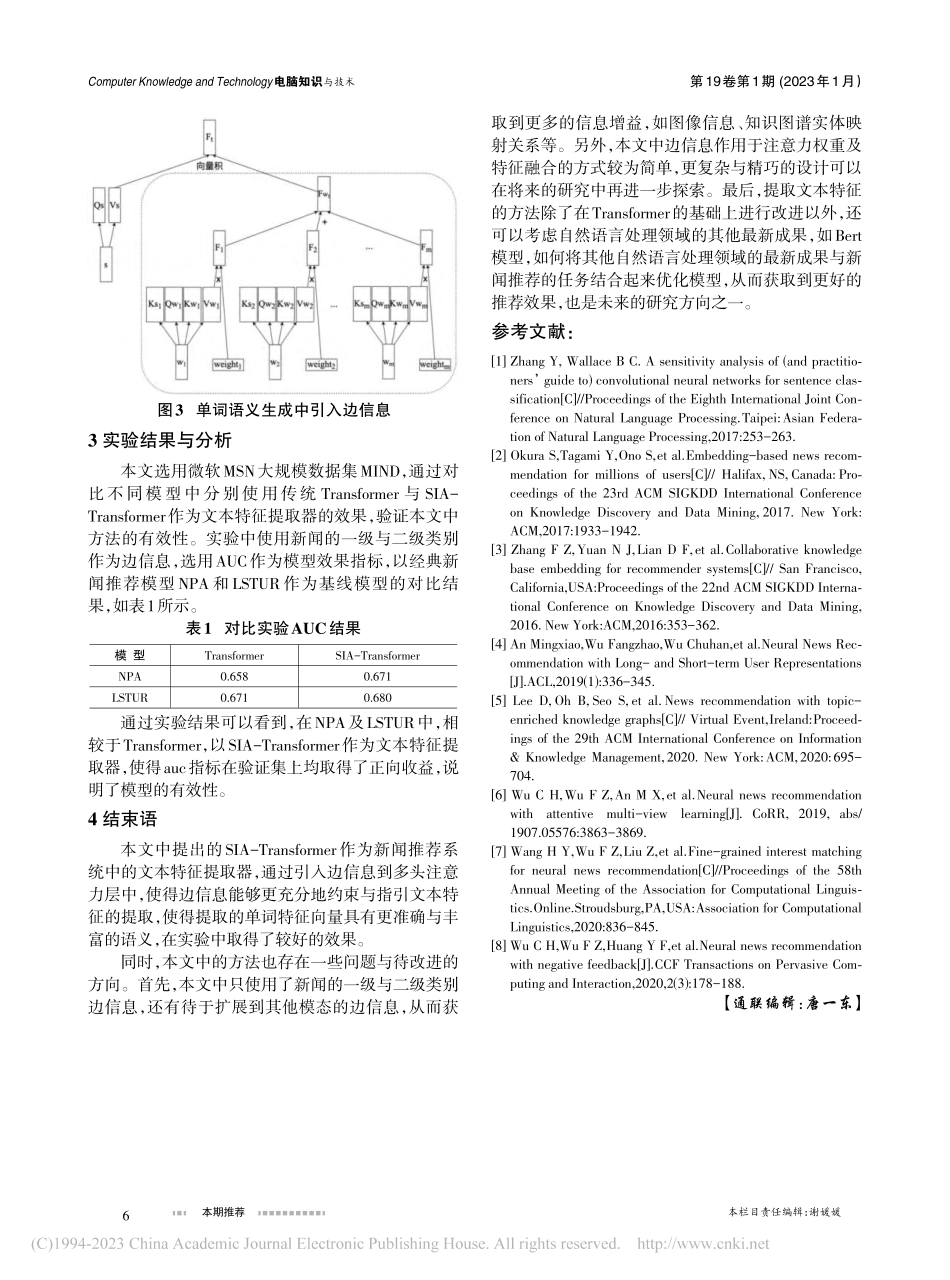

本栏目责任编辑:谢媛媛本期推荐ComputerKnowledgeandTechnology电脑知识与技术第19卷第1期(2023年1月)新闻推荐系统中的边信息融合Transformer贺隽文,邵伟,卫刚(同济大学CAD研究中心,上海201804)摘要:推荐系统中对多模态的数据处理方式是业界长期关注的重点,基于各类数据的特点设计模型,可以有效利用信息,从而提升推荐效率。文章针对新闻推荐系统提出SIA-Transformer结构,在传统Transformer的基础上结合了新闻的边信息。通过多组内积的形式,将单词特征与边信息特征在多头注意力层中进行交叉,提高了边信息利用率的同时,也丰富了文本特征提取的语义,使得基于SIA-Transformer的新闻文本特征提取方法获取到更多信息,从而提高了推荐的效果。文章基于微软MSN开放的大型新闻数据集MIND进行了实验,验证了模型的效果。关键词:新闻推荐系统;边信息;多模态;深度学习中图分类号:TP311文献标识码:A文章编号:1009-3044(2023)01-0004-03开放科学(资源服务)标识码(OSID):1概述随着消费互联网的快速发展,互联网的马太效应带来了严重的信息过载问题,推荐系统在互联网平台解决信息过载问题的过程中发挥了巨大作用。以新闻推荐系统为例,通常需要基于新闻内容、用户信息以及用户的历史行为等特征,使用自然语言处理、统计机器学习、计算机视觉等技术,精准地将新闻推送给用户。面对多模态的数据,如离散型和连续型数据、文本和图像数据、图数据等,业界的常用做法是针对不同类型的数据,分别独立地提取数据特征。当独立处理各模态数据时,缺乏各模态数据之间的交互与监督,因此难以提取到各模态数据之间的关联,导致信息的损耗。个性化新闻推荐系统中通常包含新闻模型与用户模型两大模块,前者是基于内容理解技术提取新闻的内容和特点,后者则是基于用户信息与历史点击行为来建模用户的兴趣爱好。基于协同过滤的推荐算法主要是根据用户与商品交互记录来进行推荐,本质上是基于用户/商品相似度的统计方法。在新闻推荐系统中,由于新闻商品往往具有较强的时效性,因此会面临严重的商品冷启动问题。对标题、摘要等文本信息和主题、类别等边信息的利用则是缓解商品冷启动问题的主要办法,也是新闻推荐系统中优化文本特征提取的动机。1.1相关工作现有主流的基于深度学习的新闻推荐系统通常使用自动编码器、CNN[1](卷积神经网络)、RNN(循环神经网络)、Transformer来进行文本特征的提取。Okura[2]等引入带有弱监督的自动编码器实现文本特征提...