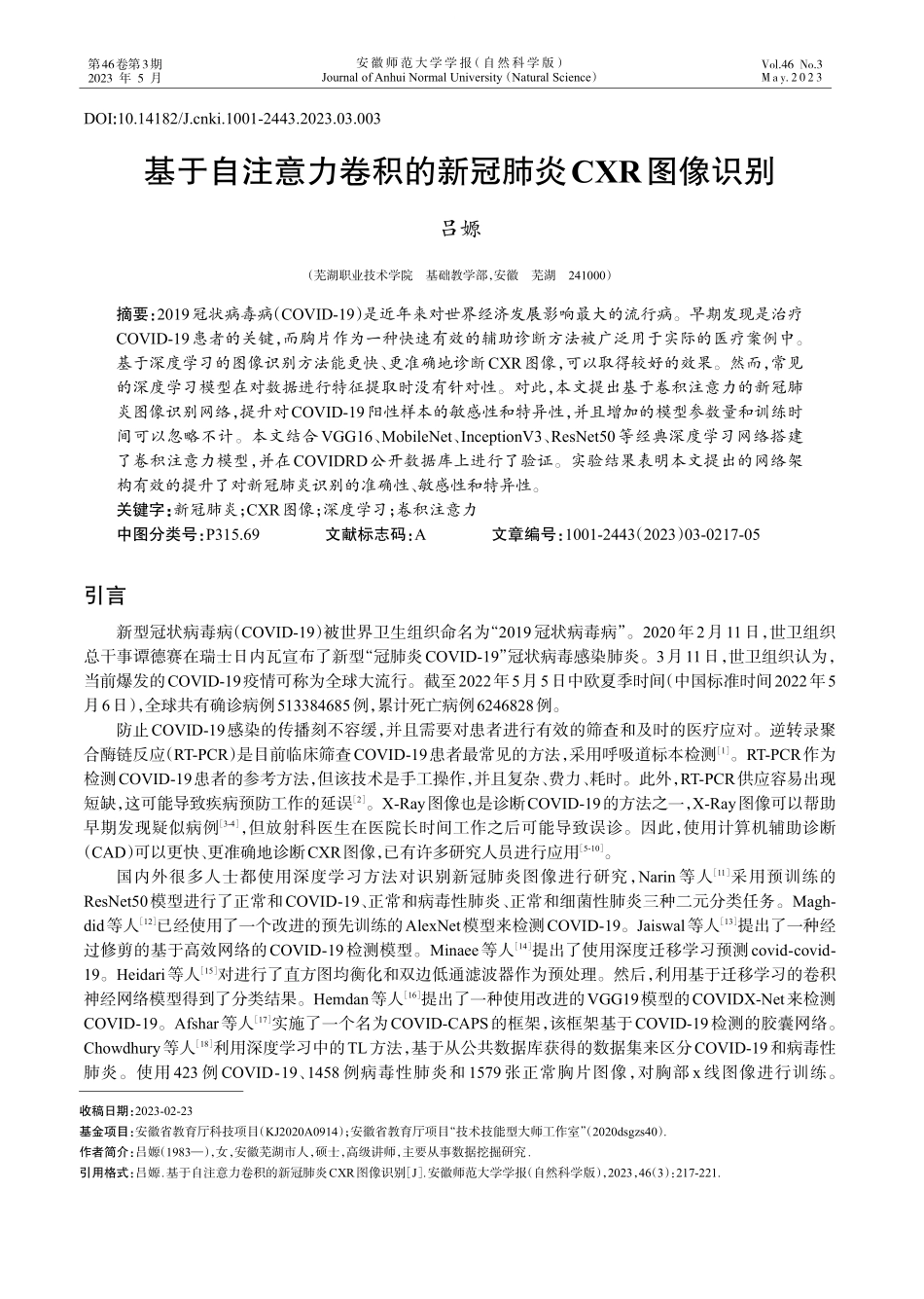

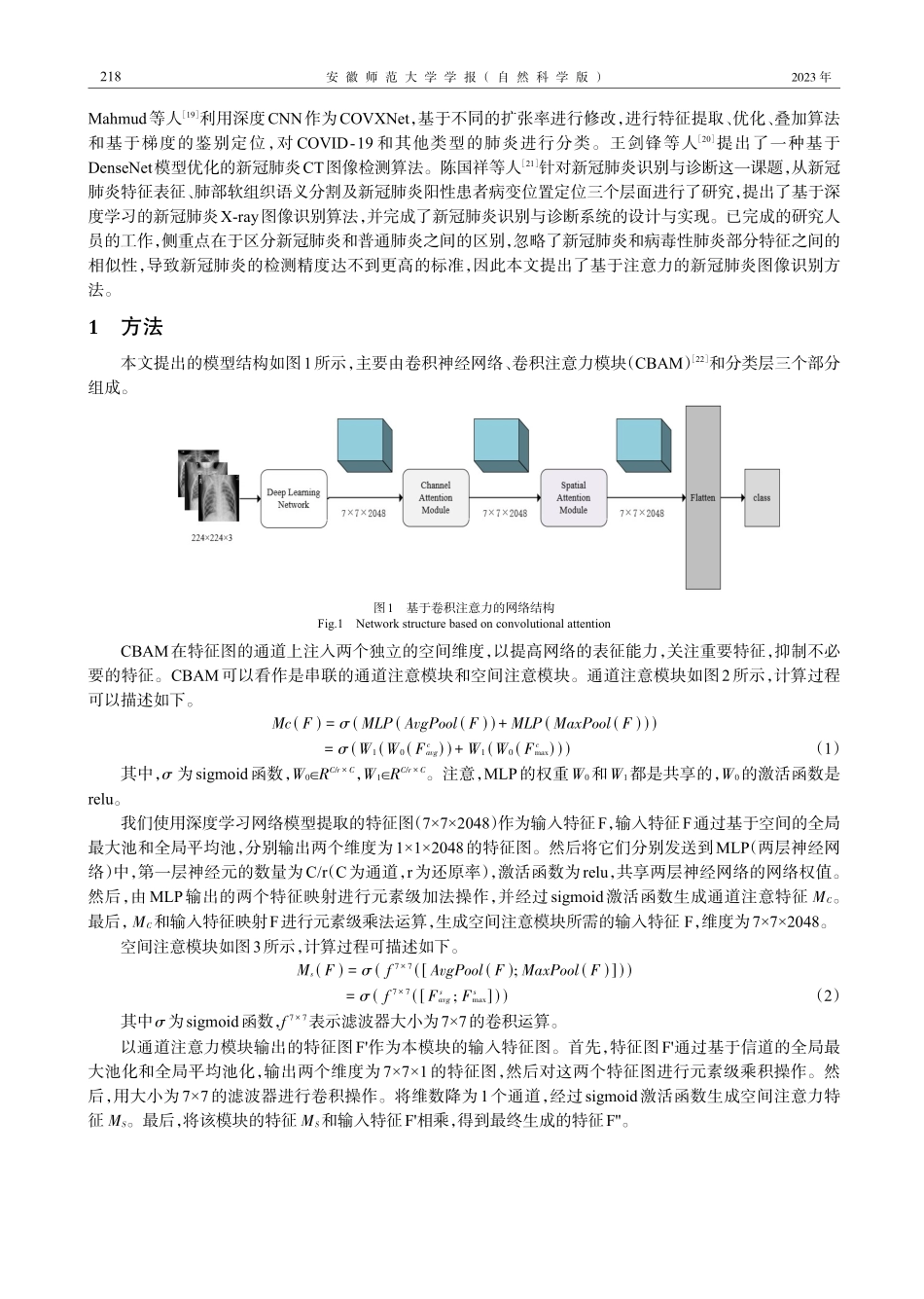

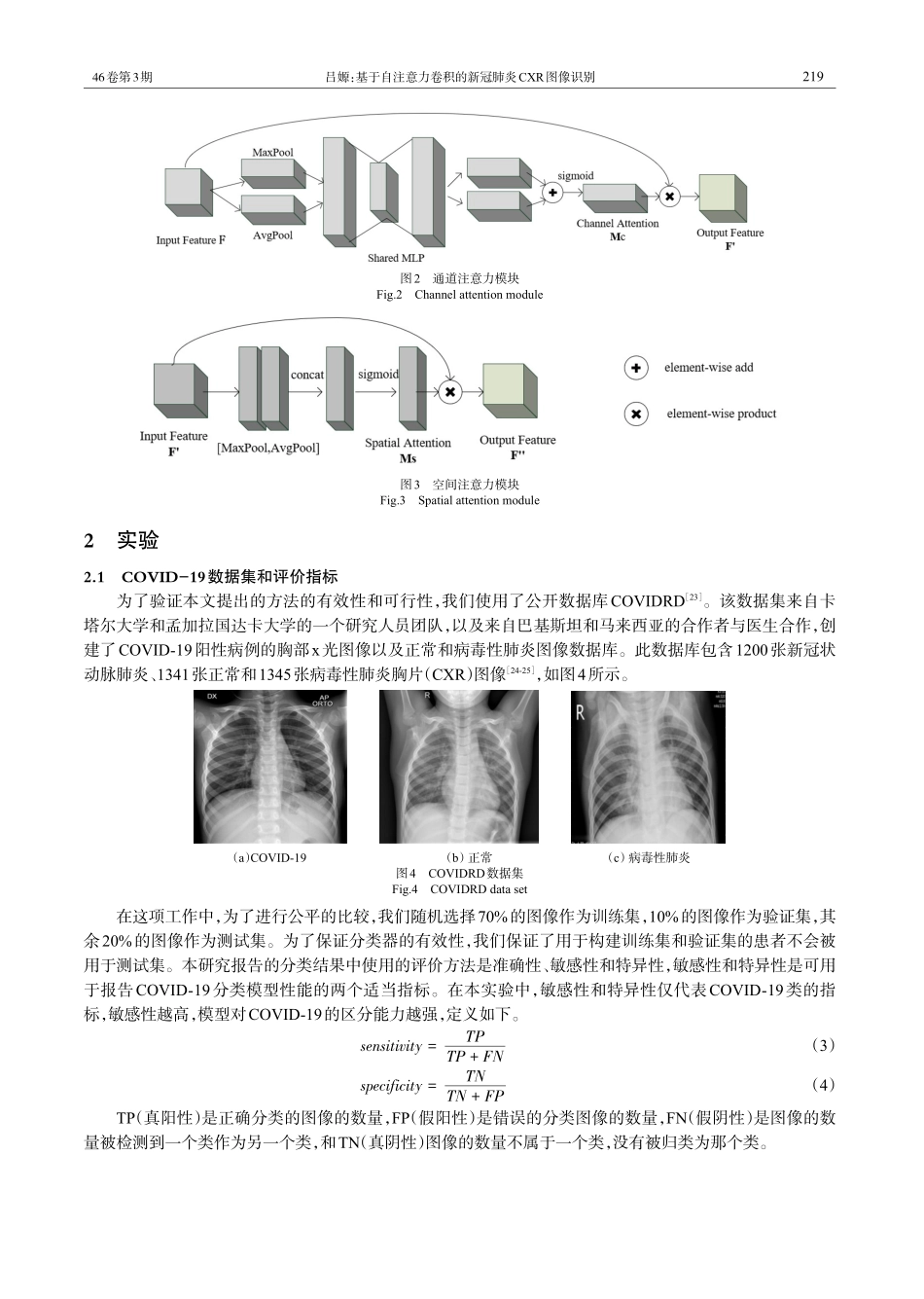

DOI:10.14182/J.cnki.1001-2443.2023.03.003基于自注意力卷积的新冠肺炎CXR图像识别吕嫄(芜湖职业技术学院基础教学部,安徽芜湖241000)摘要:2019冠状病毒病(COVID-19)是近年来对世界经济发展影响最大的流行病。早期发现是治疗COVID-19患者的关键,而胸片作为一种快速有效的辅助诊断方法被广泛用于实际的医疗案例中。基于深度学习的图像识别方法能更快、更准确地诊断CXR图像,可以取得较好的效果。然而,常见的深度学习模型在对数据进行特征提取时没有针对性。对此,本文提出基于卷积注意力的新冠肺炎图像识别网络,提升对COVID-19阳性样本的敏感性和特异性,并且增加的模型参数量和训练时间可以忽略不计。本文结合VGG16、MobileNet、InceptionV3、ResNet50等经典深度学习网络搭建了卷积注意力模型,并在COVIDRD公开数据库上进行了验证。实验结果表明本文提出的网络架构有效的提升了对新冠肺炎识别的准确性、敏感性和特异性。关键字:新冠肺炎;CXR图像;深度学习;卷积注意力中图分类号:P315.69文献标志码:A文章编号:1001-2443(2023)03-0217-05引言新型冠状病毒病(COVID-19)被世界卫生组织命名为“2019冠状病毒病”。2020年2月11日,世卫组织总干事谭德赛在瑞士日内瓦宣布了新型“冠肺炎COVID-19”冠状病毒感染肺炎。3月11日,世卫组织认为,当前爆发的COVID-19疫情可称为全球大流行。截至2022年5月5日中欧夏季时间(中国标准时间2022年5月6日),全球共有确诊病例513384685例,累计死亡病例6246828例。防止COVID-19感染的传播刻不容缓,并且需要对患者进行有效的筛查和及时的医疗应对。逆转录聚合酶链反应(RT-PCR)是目前临床筛查COVID-19患者最常见的方法,采用呼吸道标本检测[1]。RT-PCR作为检测COVID-19患者的参考方法,但该技术是手工操作,并且复杂、费力、耗时。此外,RT-PCR供应容易出现短缺,这可能导致疾病预防工作的延误[2]。X-Ray图像也是诊断COVID-19的方法之一,X-Ray图像可以帮助早期发现疑似病例[3-4],但放射科医生在医院长时间工作之后可能导致误诊。因此,使用计算机辅助诊断(CAD)可以更快、更准确地诊断CXR图像,已有许多研究人员进行应用[5-10]。国内外很多人士都使用深度学习方法对识别新冠肺炎图像进行研究,Narin等人[11]采用预训练的ResNet50模型进行了正常和COVID-19、正常和病毒性肺炎、正常和细菌性肺炎三种二元分类任务。Magh-did等人[12]已经使用了一个改进的预先训练的AlexNet模型来检...