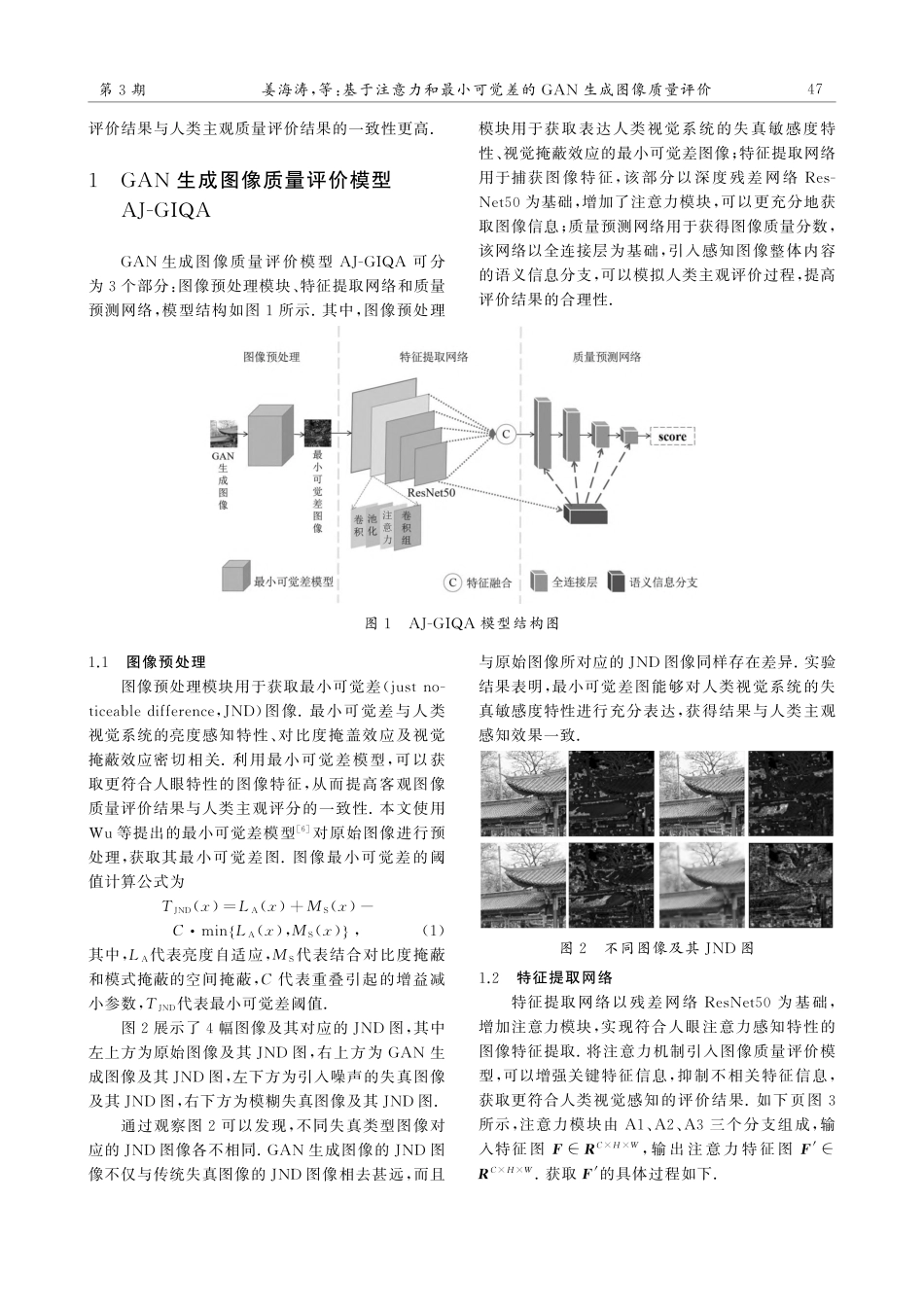

DOI:10.3969/j.issn.1001-5337.2023.3.046*收稿日期:2022-11-30基金项目:山东省自然科学基金(ZR2020MF105).第一作者:姜海涛,男,1978-,硕士,讲师;研究方向:机器学习、数据处理;E-mail:qfjht@126.com.通信作者:石珂,女,1997-,硕士,工程师;研究方向:计算机视觉、机器学习;E-mail:836851943@qq.com.基于注意力和最小可觉差的GAN生成图像质量评价姜海涛①,石珂②,齐苏敏③(①曲阜师范大学网络信息中心,273165,曲阜市;②历下区12345市民服务热线运行中心,250000,济南市;③曲阜师范大学网络空间安全学院,273165,山东省曲阜市)摘要:现有的客观图像质量评价方法用于GAN生成图像质量评价时,往往出现与人的主观评价不一致的情况.针对这个问题,提出了一种更符合人类视觉感知的GAN生成图像质量客观评价方法AJ-GIQA(attentionandjustnoticeabledifferencebasedgeneratedimagequalityassessment).首先,模拟人类视觉系统的失真敏感度特性,对GAN生成图像进行预处理,得到其最小可觉差图;然后,将注意力模块引入特征提取网络,模拟人类视觉系统的注意力机制,获取图像的显著性特征;最后,将图像特征输入结合语义信息的质量预测网络,基于图像内容综合评价GAN生成图像的质量.在GAN生成图像数据集上的实验结果表明,AJ-GIQA的评价结果与主观平均意见得分有更高的一致性;在图像质量排序一致性上的实验结果表明,AJ-GIQA的准确率在LGIQA-LSUN-cat数据集上达到了最优,和SFA方法相比性能提高了0.267;在泛化性能上的实验结果表明,与最先进的HyperIQA方法相比,AJ-GIQA在数据集PIPAL的Pearson线性相关系数提高了0.027.关键词:GAN生成图像质量评价;生成对抗网络;注意力机制;最小可觉差中图分类号:TP391文献标识码:A文章编号:1001-5337(2023)03-0046-080引言自2014年Goodfellow等提出生成式对抗网络(generativeadversarialnetworks,GAN)[1]以来,GAN在理论和应用两个方面不断发展,已经成功应用在图像生成、图像修复、图像增强和自然语言处理等领域.目前,GAN已经成为图像合成领域最受欢迎的模型之一,GAN不仅可以按照给定的图像信息生成特定图像[2],也可以根据文本描述生成一张与描述语义相似的图像[3].GAN生成图像质量评价(generatedimagequalityassessment,GIQA)[4]即对GAN模型生成图像的真实性进行评价,判断生成图像是否足够以假乱真、是否对信息接收者的主观感受、信息采集造成影响.目前GAN领域的研究热点仍聚焦于构造新模型,对GAN模型生成图像进行评价的研究较少且缺乏统一的评价标准....