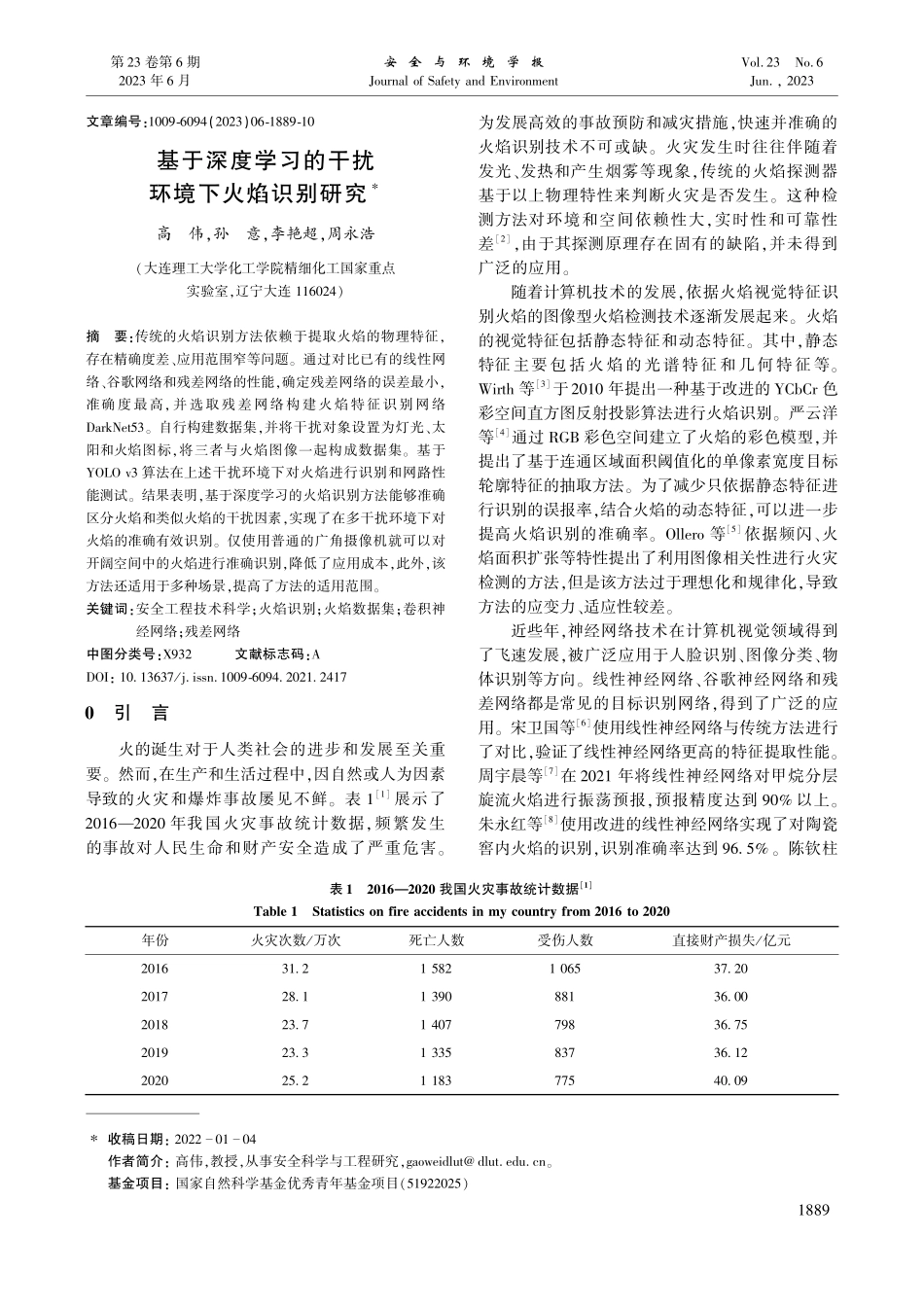

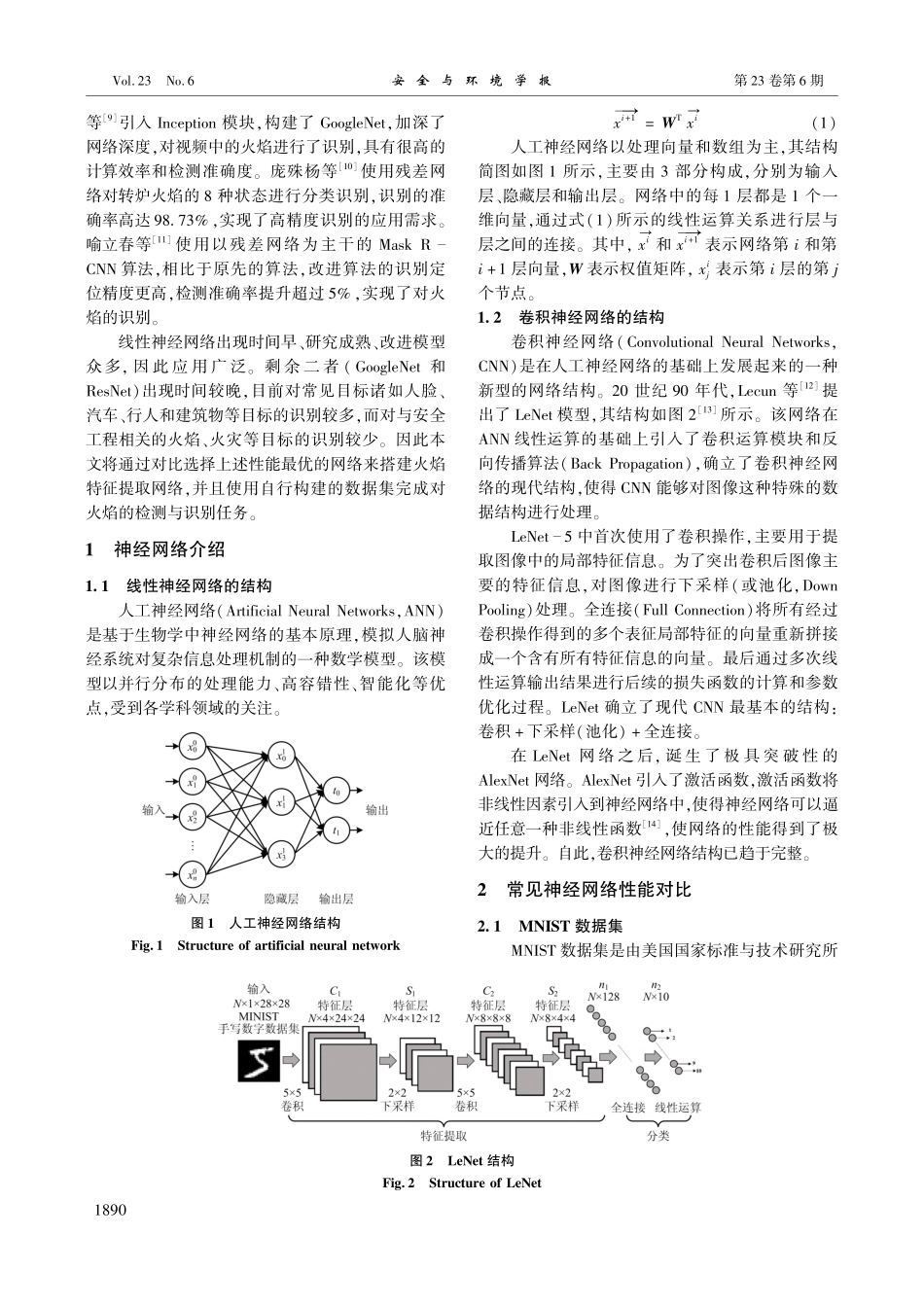

文章编号:1009-6094(2023)06-1889-10基于深度学习的干扰环境下火焰识别研究∗高伟,孙意,李艳超,周永浩(大连理工大学化工学院精细化工国家重点实验室,辽宁大连116024)摘要:传统的火焰识别方法依赖于提取火焰的物理特征,存在精确度差、应用范围窄等问题。通过对比已有的线性网络、谷歌网络和残差网络的性能,确定残差网络的误差最小,准确度最高,并选取残差网络构建火焰特征识别网络DarkNet53。自行构建数据集,并将干扰对象设置为灯光、太阳和火焰图标,将三者与火焰图像一起构成数据集。基于YOLOv3算法在上述干扰环境下对火焰进行识别和网路性能测试。结果表明,基于深度学习的火焰识别方法能够准确区分火焰和类似火焰的干扰因素,实现了在多干扰环境下对火焰的准确有效识别。仅使用普通的广角摄像机就可以对开阔空间中的火焰进行准确识别,降低了应用成本,此外,该方法还适用于多种场景,提高了方法的适用范围。关键词:安全工程技术科学;火焰识别;火焰数据集;卷积神经网络;残差网络中图分类号:X932文献标志码:ADOI:10.13637/j.issn.1009-6094.2021.2417∗收稿日期:20220104作者简介:高伟,教授,从事安全科学与工程研究,gaoweidlut@dlut.edu.cn。基金项目:国家自然科学基金优秀青年基金项目(51922025)表12016—2020我国火灾事故统计数据[1]Table1Statisticsonfireaccidentsinmycountryfrom2016to2020年份火灾次数/万次死亡人数受伤人数直接财产损失/亿元201631.21582106537.20201728.1139088136.00201823.7140779836.75201923.3133583736.12202025.2118377540.090引言火的诞生对于人类社会的进步和发展至关重要。然而,在生产和生活过程中,因自然或人为因素导致的火灾和爆炸事故屡见不鲜。表1[1]展示了2016—2020年我国火灾事故统计数据,频繁发生的事故对人民生命和财产安全造成了严重危害。为发展高效的事故预防和减灾措施,快速并准确的火焰识别技术不可或缺。火灾发生时往往伴随着发光、发热和产生烟雾等现象,传统的火焰探测器基于以上物理特性来判断火灾是否发生。这种检测方法对环境和空间依赖性大,实时性和可靠性差[2],由于其探测原理存在固有的缺陷,并未得到广泛的应用。随着计算机技术的发展,依据火焰视觉特征识别火焰的图像型火焰检测技术逐渐发展起来。火焰的视觉特征包括静态特征和动态特征。其中,静态特征主要包括火焰的光谱特征和几何特征等。Wirth等[3]于2010年提出一种基于改进的YCbCr色彩空间直方图反射投影算法进行火焰识别。严云洋等[4]通过R...