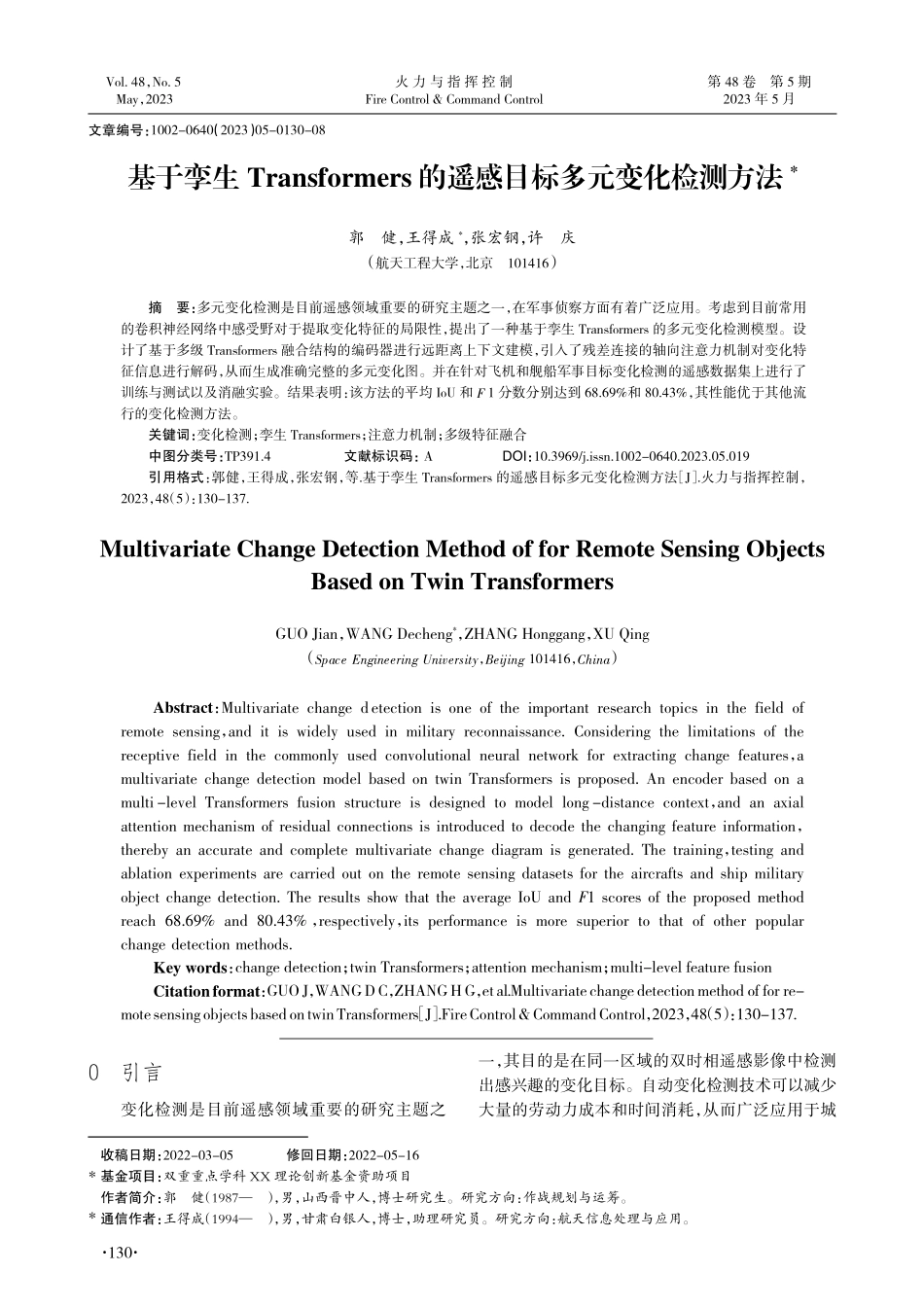

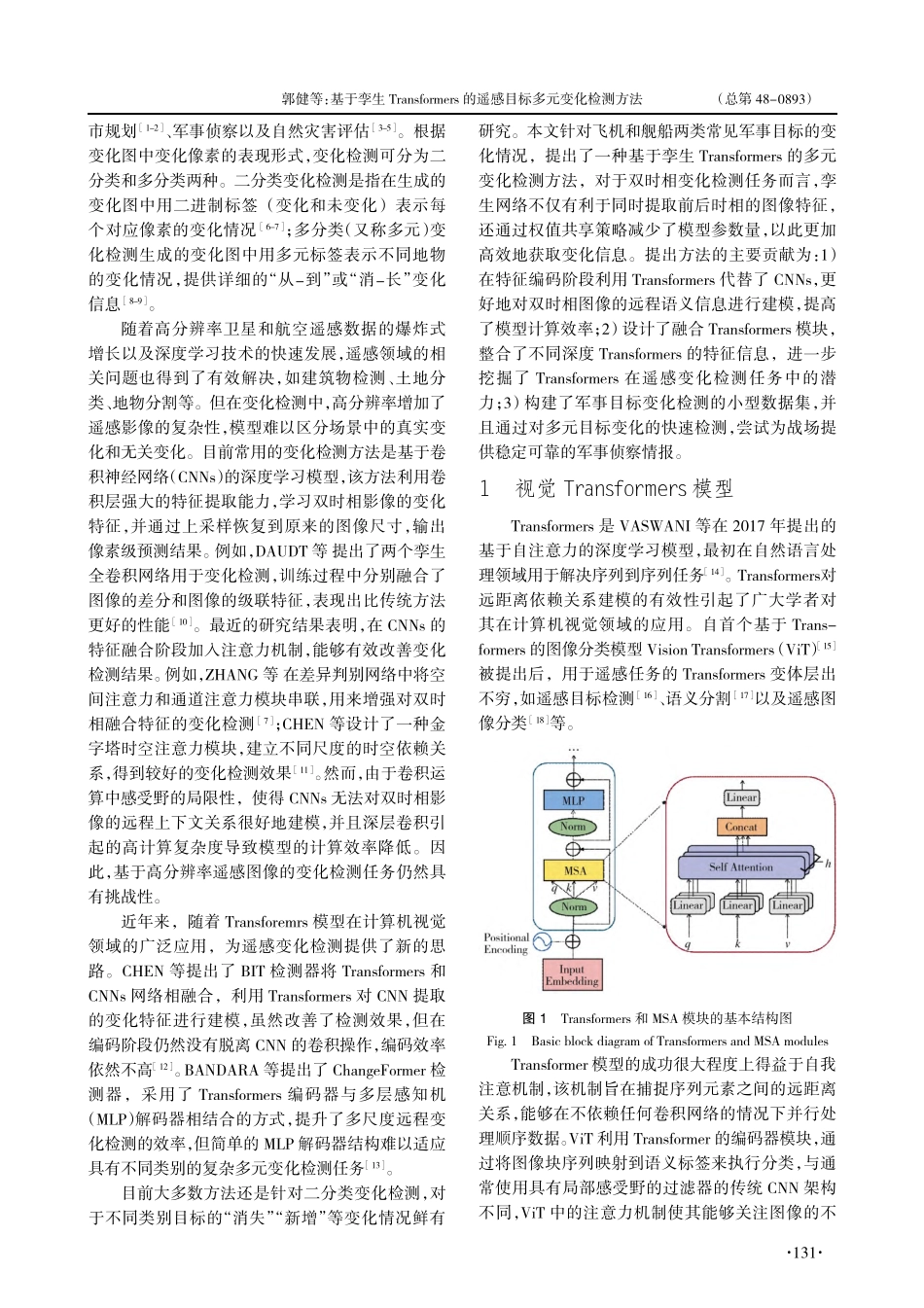

收稿日期:2022-03-05修回日期:2022-05-16基金项目:双重重点学科XX理论创新基金资助项目作者简介:郭健(1987—),男,山西晋中人,博士研究生。研究方向:作战规划与运筹。通信作者:王得成(1994—),男,甘肃白银人,博士,助理研究员。研究方向:航天信息处理与应用。*摘要:多元变化检测是目前遥感领域重要的研究主题之一,在军事侦察方面有着广泛应用。考虑到目前常用的卷积神经网络中感受野对于提取变化特征的局限性,提出了一种基于孪生Transformers的多元变化检测模型。设计了基于多级Transformers融合结构的编码器进行远距离上下文建模,引入了残差连接的轴向注意力机制对变化特征信息进行解码,从而生成准确完整的多元变化图。并在针对飞机和舰船军事目标变化检测的遥感数据集上进行了训练与测试以及消融实验。结果表明:该方法的平均IoU和F1分数分别达到68.69%和80.43%,其性能优于其他流行的变化检测方法。关键词:变化检测;孪生Transformers;注意力机制;多级特征融合中图分类号:TP391.4文献标识码:ADOI:10.3969/j.issn.1002-0640.2023.05.019引用格式:郭健,王得成,张宏钢,等.基于孪生Transformers的遥感目标多元变化检测方法[J].火力与指挥控制,2023,48(5):130-137.基于孪生Transformers的遥感目标多元变化检测方法*郭健,王得成*,张宏钢,许庆(航天工程大学,北京101416)MultivariateChangeDetectionMethodofforRemoteSensingObjectsBasedonTwinTransformersGUOJian,WANGDecheng*,ZHANGHonggang,XUQing(SpaceEngineeringUniversity,Beijing101416,China)Abstract:Multivariatechangedetectionisoneoftheimportantresearchtopicsinthefieldofremotesensing,anditiswidelyusedinmilitaryreconnaissance.Consideringthelimitationsofthereceptivefieldinthecommonlyusedconvolutionalneuralnetworkforextractingchangefeatures,amultivariatechangedetectionmodelbasedontwinTransformersisproposed.Anencoderbasedonamulti-levelTransformersfusionstructureisdesignedtomodellong-distancecontext,andanaxialattentionmechanismofresidualconnectionsisintroducedtodecodethechangingfeatureinformation,therebyanaccurateandcompletemultivariatechangediagramisgenerated.Thetraining,testingandablationexperimentsarecarriedoutontheremotesensingdatasetsfortheaircraftsandshipmilitaryo...