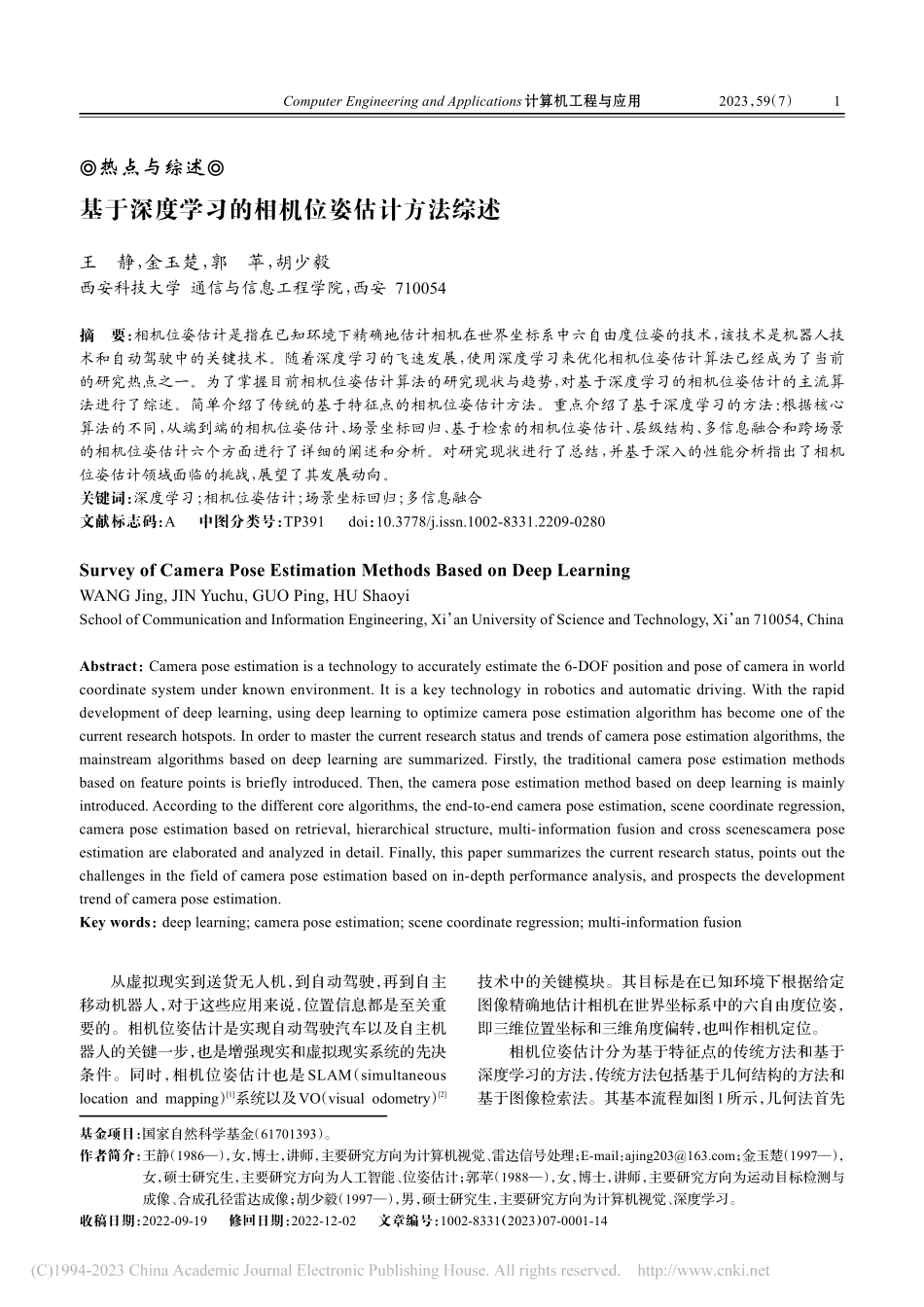

2023,59(7)⦾热点与综述⦾基金项目:国家自然科学基金(61701393)。作者简介:王静(1986—),女,博士,讲师,主要研究方向为计算机视觉、雷达信号处理;E-mail:ajing203@163.com;金玉楚(1997—),女,硕士研究生,主要研究方向为人工智能、位姿估计;郭苹(1988—),女,博士,讲师,主要研究方向为运动目标检测与成像、合成孔径雷达成像;胡少毅(1997—),男,硕士研究生,主要研究方向为计算机视觉、深度学习。收稿日期:2022-09-19修回日期:2022-12-02文章编号:1002-8331(2023)07-0001-14ComputerEngineeringandApplications计算机工程与应用从虚拟现实到送货无人机,到自动驾驶,再到自主移动机器人,对于这些应用来说,位置信息都是至关重要的。相机位姿估计是实现自动驾驶汽车以及自主机器人的关键一步,也是增强现实和虚拟现实系统的先决条件。同时,相机位姿估计也是SLAM(simultaneouslocationandmapping)[1]系统以及VO(visualodometry)[2]技术中的关键模块。其目标是在已知环境下根据给定图像精确地估计相机在世界坐标系中的六自由度位姿,即三维位置坐标和三维角度偏转,也叫作相机定位。相机位姿估计分为基于特征点的传统方法和基于深度学习的方法,传统方法包括基于几何结构的方法和基于图像检索法。其基本流程如图1所示,几何法首先基于深度学习的相机位姿估计方法综述王静,金玉楚,郭苹,胡少毅西安科技大学通信与信息工程学院,西安710054摘要:相机位姿估计是指在已知环境下精确地估计相机在世界坐标系中六自由度位姿的技术,该技术是机器人技术和自动驾驶中的关键技术。随着深度学习的飞速发展,使用深度学习来优化相机位姿估计算法已经成为了当前的研究热点之一。为了掌握目前相机位姿估计算法的研究现状与趋势,对基于深度学习的相机位姿估计的主流算法进行了综述。简单介绍了传统的基于特征点的相机位姿估计方法。重点介绍了基于深度学习的方法:根据核心算法的不同,从端到端的相机位姿估计、场景坐标回归、基于检索的相机位姿估计、层级结构、多信息融合和跨场景的相机位姿估计六个方面进行了详细的阐述和分析。对研究现状进行了总结,并基于深入的性能分析指出了相机位姿估计领域面临的挑战,展望了其发展动向。关键词:深度学习;相机位姿估计;场景坐标回归;多信息融合文献标志码:A中图分类号:TP391doi:10.3778/j.issn.1002-8331.2209-0280SurveyofCameraPoseEstimationMethodsBasedonDeepLea...