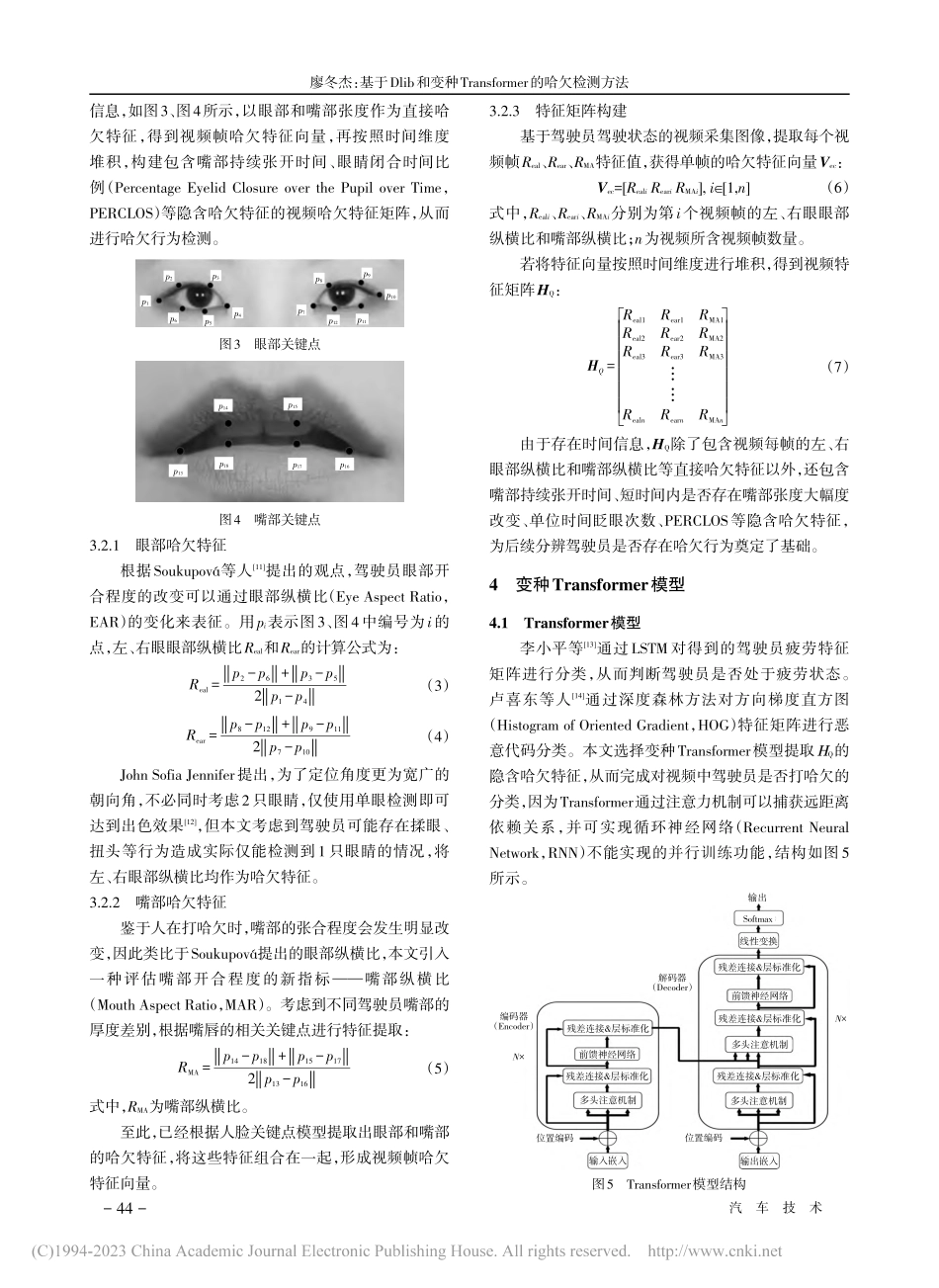

汽车技术【摘要】为及时检测驾驶员的疲劳驾驶情况,提出了一种基于Dlib和变种Transformer的哈欠检测方法。首先,基于Dlib的人脸关键点模型构建驾驶员眼部和嘴部的哈欠特征矩阵,然后在视频检测领域提出一种变种Transformer模型对哈欠特征矩阵进行提取和分类,最后基于YawDD数据集进行验证,结果表明,所提出算法的哈欠检测准确率达96.8%,高于已有算法,适用于驾驶员疲劳驾驶时哈欠行为的检测。主题词:哈欠检测Dlib哈欠特征矩阵变种TransformerYawDD中图分类号:TP391.4文献标识码:ADOI:10.19620/j.cnki.1000-3703.20220453YawnDetectionMethodBasedonDlibandVariantTransformerLiaoDongjie1,2(1.EastChinaJiaotongUniversity,Nanchang330013;2.KeyLaboratoryofAdvancedControlandOptimizationofJiangxiProvince,Nanchang330013)【Abstract】Inordertodetectthedriver’sfatiguedrivingsituationintime,thispaperproposedayawndetectionmethodbasedonDlibandvariantTransformer.First,theyawnfeaturematrixofthedriver’seyesandmouthwasconstructedbasedonthefacekeypointmodelofDlib.ThenavariantTransformermodelwasproposedinthefieldofvideodetection,toextracttheyawnfeaturematrixandclassifytheresults.Finally,itwasverifiedbasedontheYawDDdataset.Theresultsshowthattheyawndetectionaccuracyoftheproposedalgorithmis96.8%,whichishigherthantheexistingalgorithms,andissuitableforthedetectionofyawningbehaviorwhenthedriverisfatigued.Keywords:Yawndetection,Dlib,Yawningfeaturesmatrix,VariantTransformer,YawDD廖冬杰1,2(1.华东交通大学,南昌330013;2.江西省先进控制与优化重点实验室,南昌330013)基于Dlib和变种Transformer的哈欠检测方法汽车技术·AutomobileTechnology【引用格式】廖冬杰.基于Dlib和变种Transformer的哈欠检测方法[J].汽车技术,2023(3):42-48.LIAODJ.YawnDetectionMethodBasedonDlibandVariantTransformer[J].AutomobileTechnology,2023(3):42-48.1前言疲劳驾驶是造成交通事故的主要原因之一[1],而打哈欠是驾驶员疲劳初期的主要表现形式之一[2]。因此,研究驾驶员疲劳初期的哈欠特征,从而进行准确检测,对保障道路交通安全具有重要意义。国内外研究人员针对哈欠检测已进行了大量的研究。马素刚等[3]充分关注人脸的各种特征,以驾驶员面部图片作为输入,通过卷积核进行特征提取,并利用Softmax分...